Named entity recognition of railway freight competitive pricing strategy based on RoBERTa-BiLSTM-CRF model

-

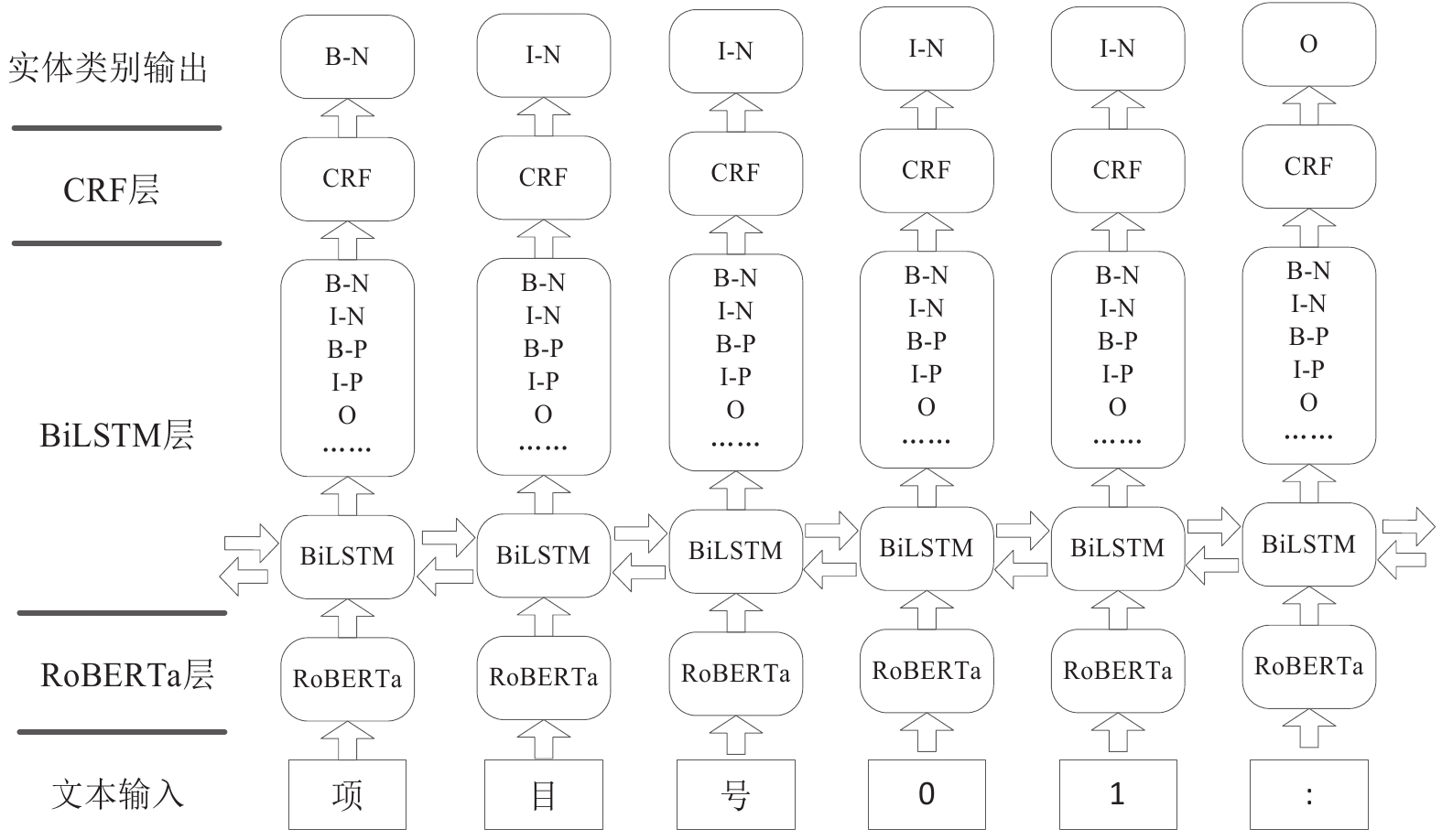

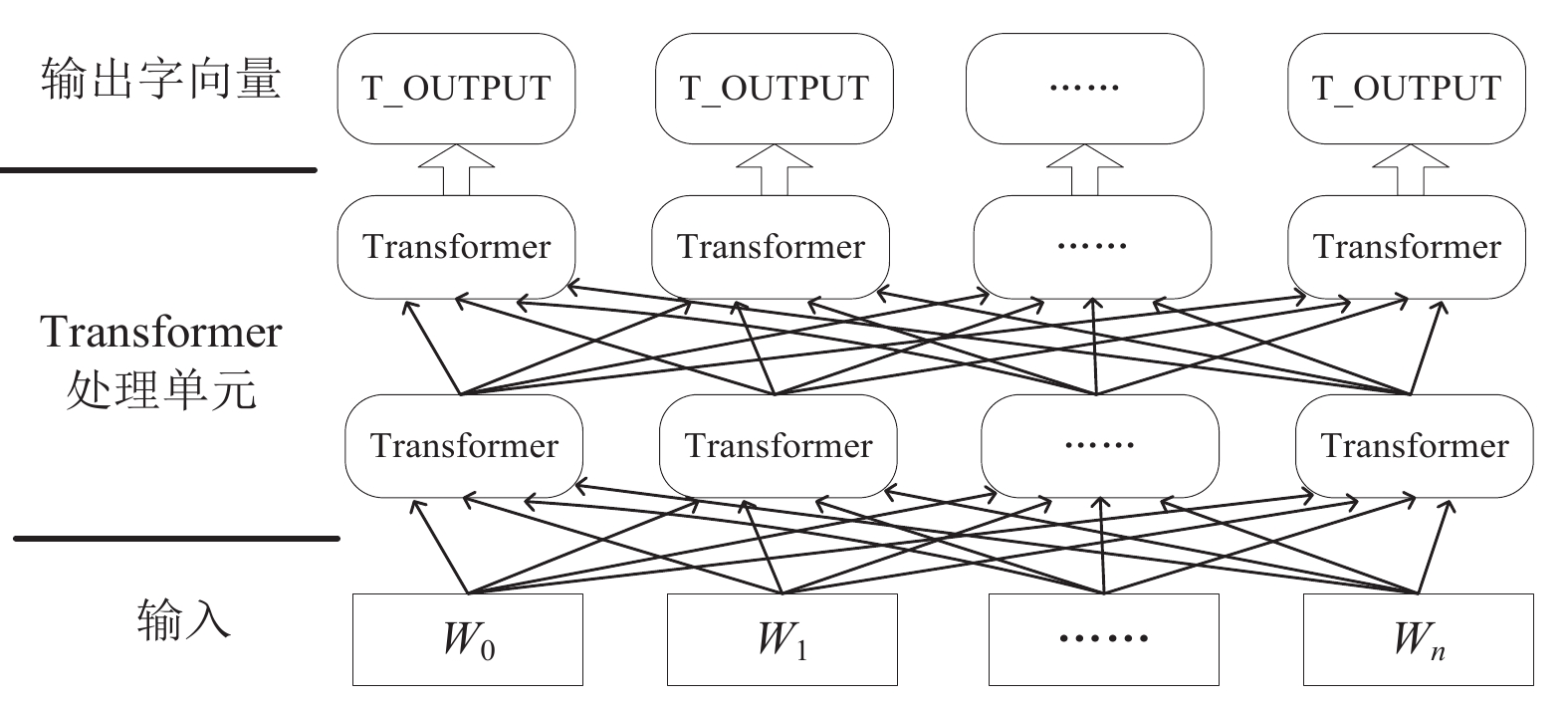

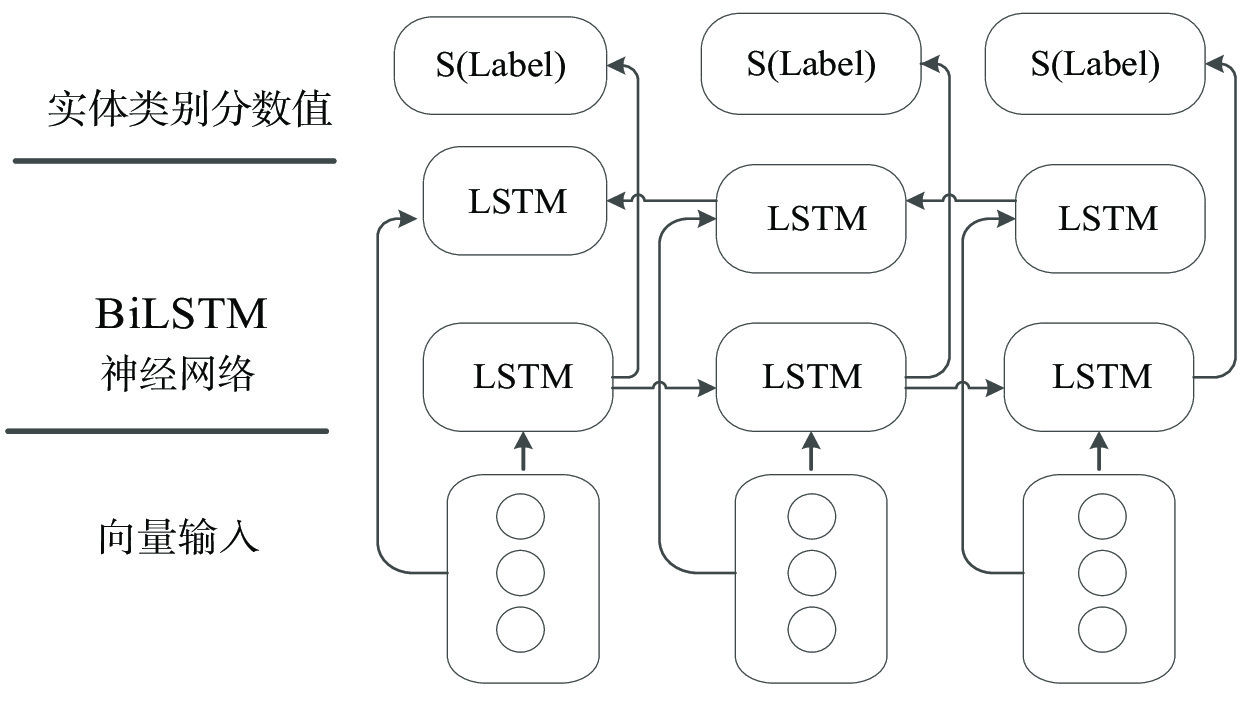

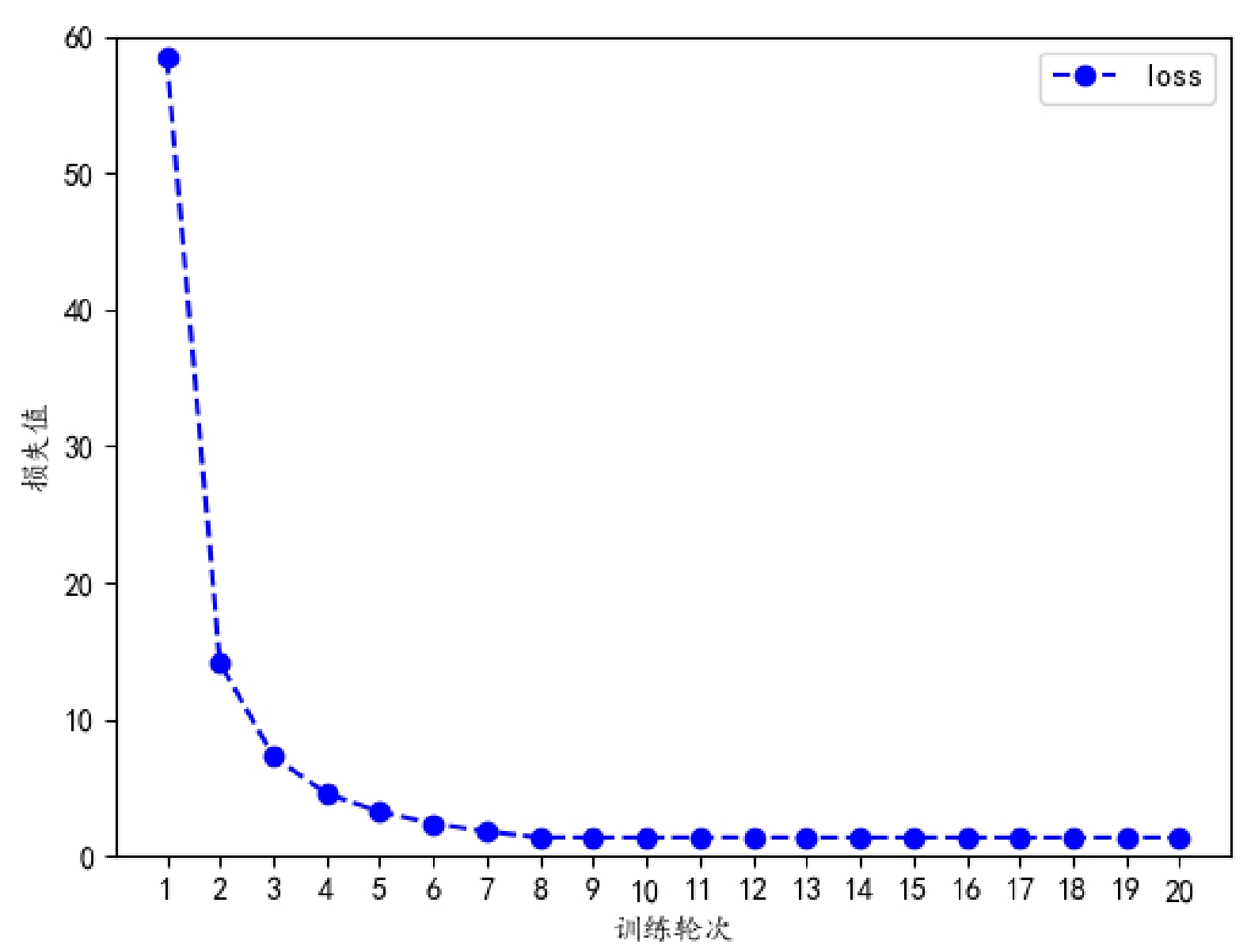

摘要: 为提升铁路货运审计工作的效率,针对铁路货运一口价议价策略(简称:一口价策略)的文本数据,设计了基于数据增强的RoBERTa(Robustly optimized Bidirectional Encoder Representation from Transformers)-BiLSTM(Bidrectional Long Short Term Memory)-CRF(Conditional Random Field)模型,介绍了数据标注策略,详细阐述了模型的总体架构和样本数据增强方法。对所设计的模型进行了应用验证,验证结果表明, RoBERTa-BiLSTM-CRF模型对一口价策略中命名实体识别的各项性能评价指标较其他2种传统模型均有显著提高,能够更准确地识别一口价策略中的命名实体信息,辅助铁路货运审计人员的审计工作。

-

关键词:

- 铁路货运 /

- 货运审计 /

- RoBERTa-BiLSTM-CRF模型 /

- 数据增强 /

- 实体识别

Abstract: In order to improve the efficiency of railway freight audit work, this paper focused on the text data of railway freight competitive pricing strategy and designed a RoBERTa (Robustly optimized Bidirectional Encoder Representation from Transformers) -BiLSTM (Bidrectional Long Short Term Memory) -CRF (Conditional Random Field) model based on data augmentation, introduced the data annotation strategy and elaborated on the overall architecture of the model and the sample data enhancement method, conducted application validation on the designed model. The validation results show that the performance evaluation indicators of named entity recognition in railway freight competitive pricing strategy of the RoBERTa-BiLSTM-CRF model are significantly improved compared to the other two traditional models, which can more accurately identify named entity information in the railway freight competitive pricing strategy and assist railway freight auditors in their audit work. -

城市轨道交通凭借其安全快捷等优势,在我国公共交通系统中快速发展,成为缓解城市运输压力的重要工具。城市轨道交通的高速发展也对行车安全及运输效率等各方面提出了更高的要求。性能稳定、技术先进的全自动运行技术应运而生,近几年被大量应用于我国地铁线路的新线建设和旧线改造[1]。

在全自动运行线路中,司机原有职责转向调度中心,调度中心远程控制能力增强,要求调度系统具有更好的互操作性和实时性。针对传统运营模式分立设置的调度系统,不利于实现信息的高效共享,调度指挥效率较低,不能充分发挥全自动运行优势,其仿真系统无法满足全自动运行线路仿真需求[2-3]。因此,需要有一套针对全自动运行线路特点及需求而设计的仿真系统,为调度人员培训等工作提供支持。

城市轨道交通全自动运行线路调度系统基于计算机、通信、控制和系统集成等技术,以行车调度为核心、联合多专业、实时远程监测现场、指导列车自动化运行[4-5]。本文以上海地铁14号线调度系统为仿真对象,对该系统进行仿真研究,建立系统仿真模型,并选取部分行车调度、列车调度、乘客调度功能进行仿真分析,实现了行车模拟及站场图显示、列车运行信息及设备健康状态监测、车载PIS信息管理等功能。

1 上海地铁14号线调度系统总体架构

上海地铁14号线全程共有31座车站,设有2处车辆基地,1个控制中心。该线路调度系统涉及对象包括信号、车辆、行车、综合监控、通信、供电等专业,按中心层、车站/车场层(含轨旁)和车载层进行配置,通过骨干网及无线通信系统完成数据信息交互。系统架构如图1所示。

1.1 中心层

中心层包含位于控制中心的调度工作台及服务器等计算机系统,负责获取车站/车场层、车载层设备信息并展示,下发调度命令。按照控制中心工作内容,划分为行车调度、列车调度、乘客调度、电力调度、环控调度,且配有实时服务器及备用统一调度服务器。中心调度员可通过多功能调度界面远程监视和控制列车运行状态,查看设备状态、环境信息,下发命令进行调度指挥。上海地铁14号线调度系统架构,如图1所示。

1.2 车站/车场层

车站/车场层负责采集车站、车场、轨旁信息并传输至控制中心,响应指令控制联锁系统及其它设备,接收车载定位信息,完成运行线的联锁、轨旁控制等功能。通过转辙机、信号机、轨旁人员作业防护开关(SPKS)等设备,采集轨旁信息。采用计算机联锁(CI)系统、区域控制(ZC)系统,配合完成进路及远程控制命令,设置临时限速,向控制中心传递轨旁状态信息、线路状态数据[6]。车站乘客信息系统(PIS)、综合监控系统(IMS)、语音通信系统、广播系统(PA)的状态信息也将实时传输至控制中心。

1.3 车载层

车载层负责采集并发送列车信息,接收控制中心指令,通过车载信号设备,配合实现列车自动运行。车载设备采集列车牵引、制动、车门、烟火、紧急呼叫按钮等各子系统数据,通过车载无线单元与控制中心通信,完成关于车辆控制系统(TCMS)、车载PIS、PA等信息的传送。

2 仿真系统功能

本系统选取上海地铁14号线调度系统中心层进行仿真,模拟实现行车调度、列车状态监测等功能。

2.1 用户登录

提供创建和管理用户功能,设置不同级别权限的用户。用户输入用户号和密码进行登录操作,登陆前禁用多数命令菜单和功能。

2.2 行车调度

完成基本行车调度功能,包括行车信息显示、列车运行模拟、列车运营调整等。通过站场图展示线路运行情况、列车运行位置,信号灯、道岔状态等,对线路设备进行状态监测。

2.3 列车状态监测

显示列车运行信息及车载设备信息,包括通信状态、牵引、制动、车门、照明和空调等。对列车状态进行全方位的监控,使中心调度员能方便快捷地了解列车运行情况,保证行车安全[7]。

2.4 故障报警

接收车辆和信号设备的报警信息,按列车、轨旁、调整、其它类别划分。将报警信息赋予不同优先级,进行区别处理。突出显示未经过确认的报警信息,并记录历史报警信息。

2.5 乘客服务

可实时查看车载PA / 视频监控系统(CCTV) / PIS信息,并下发信息进行调度管理与乘客服务[8]。

2.6 数据库管理及统计报表

管理历史数据及实时运行数据,包括线路数据、列车数据、报警信息等。生成和管理报警报表、事件报表、数据统计报表、运行日志报表等。操作员可以按事件类型、时间、特定列车等分类筛选查看。

3 仿真系统实现

采用C++编写该仿真软件,并采用基于VC++的MFC类库编写操作界面,实现界面与逻辑代码的分离。本文选取部分功能及界面,介绍其实现及内部逻辑。

3.1 主界面

启动软件进行登录后进入主界面,界面整体包括菜单栏、工具栏、主窗口等部分。主界面菜单栏通过CMenu类实现,根据用户权限配置功能。用户可通过菜单进行对列车、线路的操作。界面主窗口默认显示站场图概览。使用工具栏中窗口选择图标,可将主窗口显示内容切换为报警信息、系统状态、用户授权等,且可通过工具栏执行切分窗口、缩放视图等操作,工具栏通过CToolBar类实现。

3.2 站场图概览窗口

站场图概览窗口如图2所示,通过行车调度仿真,采用不同颜色的图标和文字,动态展示列车ID及状态、站台名称及状态、计轴位置、区段、道岔、信号机ID及占用情况等内容。采用双缓冲技术动态绘制站场图,避免画面反复闪烁。

(1)图2中浅灰色宽线条表示轨道,未被其它颜色覆盖时,表示该区段空闲。车站图形显示为蓝底黑边矩形,表示此车站空闲。

(2)以列车车体箭头方向表示行进方向。以列车ID颜色表示准点情况,图中列车ID“1001GQ”为黑色,表示列车准点。

(3)列车前方绿色箭头及实线代表当前列车的移动授权(LMA)进路,进路上的道岔及其相关道岔均被联锁预留,以紫色圆点表示。

(4)LMA所穿越的信号机为绿色,表示正常开放;其余信号机为红色,表示关闭。

3.3 行车调度仿真流程

行车调度仿真流程,如图3所示,核心在于列车速度、位置的计算及命令的处理。采用时间步长法进行仿真,定时循环计算每列车的位置和速度。根据理想运行曲线,考虑线路限速、坡度、弯道等因素,对不同工况下的列车进行受力分析,对变加速的牵引、惰行、制动过程进行模拟。相比于单纯地认为每一种工况下具有相同的加速度,本方法更好地保证了仿真的精度,且更加贴近真实场景。系统亦可处理多种人工命令,包括跳停、扣车、非计划调整等运营调整命令,远程复位、旁路等操作,可应对全自动运行线路的多种场景需求。

3.4 列车信息查看

点击站场图中运行列车,或点击主菜单栏列车选项,触发OnRButtonDown()函数弹出子菜单,可选择“列车运行信息”或“列车设备健康信息”,查看相应界面。该过程内部处理流程,如图4所示。

(1)列车运行信息界面,如图5所示。界面左侧为列车列表,显示列车ID号、列车班次号、运行线信息,调度员可点击选择。界面右侧展示详细信息,包括:运行模式、状态、方向、停站站台、列车LMA或人工授权(AMT)的始端和终端等。

(2)列车设备健康状态界面,如图6所示,监测设备包括主风缸、受电弓、受电弓检测系统、空压机、空气簧压力、轴温监测系统、停放制动、微型断路器、烟火检测器、司机驾驶台盖子、蓄电池充电机、辅助逆变器、机械制动、牵引逆变器、脱轨检测系统等。

3.5 车载PIS信息下发

用户可通过点选方式完成车载PIS信息查看及命令下发,以车载PIS信息下发为例,其流程如图7所示。可选择下发预定义常规信息及紧急信息,或按需求编辑信息,并为其设置属性为常规或紧急。信息优先级排布为:自定义紧急信息>预定义紧急信息>自定义常规信息>预定义常规信息。进行重发次数设置及发布列车选择后,信息进入消息队列,按优先级从高到低排列,依次进行发送。

4 结束语

本文以当前建设的上海地铁14号线控制中心调度系统作为仿真对象,对城市轨道交通全自动运行线路调度系统的基本架构进行了研究。选取行车调度、列车运行信息及设备健康状态监测、车载PIS信息管理等功能进行了仿真实现,形成了以行车为核心、涉及多专业、具有良好人机交互的调度仿真系统,符合全自动运行中控制系统智能化、多专业融合的发展趋势。该仿真系统对调度人员培训、设备验证测试等有较好的实用价值。

-

表 1 一口价策略命名实体信息列表

序号 实体名称 标注标识 序号 实体名称 标注标识 1 项目号 N(Number) 7 新增发站站名 NS(New-Start) 2 托运人 P(People) 8 取消发站站名 CS(Cancel-Start) 3 价差系数 C(Coefficient) 9 到站站名 A(Arrive) 4 考核有效期 T(Time) 10 新增到站站名 NA(New-Arrive) 5 考核运量 F(Freight) 11 取消到站站名 CA(Cancel-Arrive) 6 发站站名 S(Start) 表 2 模型评价指标对比

模型名称 P R F BiLSTM-CRF 89.38% 90.10% 89.74% BERT-BiLSTM-CRF 91.15% 90.29% 90.72% RoBERTa-BiLSTM-CRF 94.69% 92.52% 93.59% 表 3 基于不同训练样本的模型的评价指标对比

训练样本 P R F 未增强 87.61% 88.89% 88.25% 已增强 94.69% 92.52% 93.59% -

[1] 黄永亮,吴志伟. 基于比价的铁路货运一口价策略研究 [J]. 铁路计算机应用,2021,30(8):24-28. DOI: 10.3969/j.issn.1005-8451.2021.08.05 [2] Lafferty J D, McCallum A K, Pereira F C N. Conditional random fields: probabilistic models for segmenting and labeling sequence data[C]//Proceedings of the Eighteenth International Conference on Machine Learning, 28 June, 2001, San Francisco, USA. New York, USA: Morgan Kaufmann Publishers Inc. , 2001: 282-289.

[3] HUANG Z, XU W, YU K. Bidirectional LSTM-CRF models for sequence tagging[EB/OL].(2015-08-09)[2022-11-04]. https://arxiv.org/abs/1508.01991. [4] Ma X Z, Hovy E. End-to-end sequence labeling via bi-directional LSTM-CNNs-CRF[C]//Proceedings of the 54th Annual Meeting of the Association for Computational Linguistics, 7-12 August, 2016, Berlin, Germany. Association for Computational Linguistics, 2016. 1064-1074. [5] Vaswani A, Shazeer N, Parmar N, et al. Attention is all you need[C]//Proceedings of the 31st International Conference on Neural Information Processing Systems, 4 December, 2017, Long Beach, USA. Red Hook, USA: Curran Associates Inc. , 2017: 6000-6010.

[6] 汪 政, 张 勇, 金丽丽, 等. 航变信息提取方法及系统: 中国, CN108595430A[P]. 2018-09-28. [7] 杨 祎,崔其会,丁奕齐. 面向电网设备故障报告的半监督命名实体识别方法 [J]. 计算机应用,2021,41(S2):41-47. [8] 李 韧,李 童,杨建喜,等. 基于Transformer-BiLSTM-CRF的桥梁检测领域命名实体识别 [J]. 中文信息学报,2021,35(4):83-91. DOI: 10.3969/j.issn.1003-0077.2021.04.012 [9] 赵瑞晨. 基于深度学习的铁路设备事故数据挖掘与分析[D]. 北京: 北京交通大学, 2020. [10] 李新琴,史天运,李 平,等. 基于文本的高速铁路信号设备故障知识抽取方法研究 [J]. 铁道学报,2021,43(3):92-100. DOI: 10.3969/j.issn.1001-8360.2021.03.012 [11] 杨连报, 王同军, 李新琴, 等. 一种铁路文本命名实体识别方法及装置: 中国, CN111191452A[P]. 2020-05-22. [12] 靳 征. 铁路货运数字化审计分析模型构建探讨 [J]. 铁道经济研究,2022(5):10-13. DOI: 10.3969/j.issn.1004-9746.2022.05.003 [13] LIU Y, OTT M, GOYAL N, et al. RoBERTa: a robustly optimized BERT pretraining approach [ EB / OL] . ( 2019-07-26) [2022:11-04] .https://doi. org / 10. 48550 / arXiv. 1907. 11692. [14] Devlin J, Chang M W, Lee K, et al. BERT: pre-training of deep bidirectional transformers for language understanding[C]//Proceedings of 2019 Conference of the North American Chapter of the Association for Computational Linguistics, 2-7 June, 2019, Minneapolis, Minnesota. Association for Computational Linguistics, 2018: 4171-4186. -

期刊类型引用(23)

1. 方义,齐鹤,陆鹏,张华,杨赓. 基于人工智能技术的铁路电子公文数据智能化分析及关联方法研究. 铁路计算机应用. 2024(01): 67-71 .  本站查看

本站查看

2. 郭悦,王志华,关则彬. 基于数字孪生的数字环铁总体设计与实现. 铁路计算机应用. 2024(06): 67-73 .  本站查看

本站查看

3. 赵红卫,高枫,穆瑞琦,叶鹏迪. 智能高速动车组关键技术现状及展望. 中国铁路. 2024(07): 77-86 .  百度学术

百度学术

4. 宋明,徐晓建. 基于5G网络与夜视系统的高速铁路昼夜实时监控技术. 中国铁路. 2024(08): 131-138 .  百度学术

百度学术

5. 彭凯贝,徐巍,李书臣,卜令彬,王小书. 基于三维激光扫描的铁路客运站台限界测量方法研究. 铁路计算机应用. 2024(12): 8-13 .  本站查看

本站查看

6. 王元媛,卢元惠,张名妹,纪军军,耿双. 面向冬奥的京张高速铁路票务管理应急方案研究. 铁道运输与经济. 2023(05): 22-28 .  百度学术

百度学术

7. 王科,贡照华,沈鹍,樊涛,汪明薇. 工务站场设备检修智能运维系统的设计与应用. 铁路计算机应用. 2023(06): 31-35 .  本站查看

本站查看

8. 柳青红,赵颖,罗浩,关则彬,匡建立. 基于5G公网的高速铁路运营线路列车超视距应用系统试验方案研究. 铁路计算机应用. 2023(06): 62-70 .  本站查看

本站查看

9. 郭战伟,史维峰,李俊波,沈鹍,王东妍,温桂玉. 线路安全环境管理系统设计与实现. 中国铁路. 2023(09): 34-39 .  百度学术

百度学术

10. 吴丽,李平,刘忠东,苏尔慈,于行健. 雅万高铁智能信息化方案研究. 中国铁路. 2023(12): 154-162 .  百度学术

百度学术

11. 卢文龙,王万齐,王都,冯云梅,林峰. 数字环铁试验基地的思考与设计. 中国铁路. 2022(02): 126-134 .  百度学术

百度学术

12. 王浩. 从编辑工作角度探讨打造精品科技期刊的途径. 传播与版权. 2022(04): 20-22 .  百度学术

百度学术

13. 苗义烽,齐威,傅钟晖,王振东. 京张高铁智能调度集中系统示范应用. 铁道通信信号. 2022(06): 1-6+11 .  百度学术

百度学术

14. 卓越. 京张高铁官厅水库特大桥工程智能建造及智能运维技术应用方案. 铁路计算机应用. 2022(07): 37-41 .  本站查看

本站查看

15. 王同军. 中国智能高速铁路2.0的内涵特征、体系架构与实施路径. 铁路计算机应用. 2022(07): 1-9 .  本站查看

本站查看

16. 傅荟瑾,郭鹏跃,徐成伟,张万鹏,马祯. 基于多传感技术融合的高速铁路周界入侵监测技术方案研究. 铁道运输与经济. 2022(09): 122-129 .  百度学术

百度学术

17. 吴首蓉,张志强,周自昌,苏建飞. 面向冬奥注册人员的京张高速铁路票务服务方案研究. 铁道运输与经济. 2022(09): 26-33 .  百度学术

百度学术

18. 方凯,史天运,陈瑞凤,钱克非. 面向北京冬奥会的京张高速铁路旅客服务智能化成套关键技术研究. 铁道运输与经济. 2022(09): 56-62 .  百度学术

百度学术

19. 唐雯,吴兴华,杨栋. 冬奥背景下铁路旅客服务与生产管控平台适配提升研究及应用. 铁道运输与经济. 2022(09): 90-95 .  百度学术

百度学术

20. 耿肖. 大型既有高铁车站改造中接触网设计方案研究. 电气化铁道. 2022(05): 59-63 .  百度学术

百度学术

21. 马建军. 京张高速铁路智能化服务关键技术研究与冬奥科技保障应用示范. 铁道运输与经济. 2022(09): 1-10 .  百度学术

百度学术

22. 周清华,杨璟林,李纯,张轩. 京张高铁八达岭地下站及隧道工程信息模型一致性表达. 铁路计算机应用. 2022(10): 26-32 .  本站查看

本站查看

23. 马建军,谢鹏,王乔,许红,马志强. 中老铁路运输一体化平台总体架构研究及国际化示范应用. 铁道运输与经济. 2022(11): 19-26 .  百度学术

百度学术

其他类型引用(7)

下载:

下载: