Aided inspection system of railway based on deep learning

-

摘要: 针对人工巡检方式错漏多、强度大、成本高的问题,设计基于深度学习和虚拟现实(VR)远程控制技术的铁路辅助巡检系统。该巡检系统结合开源数据集和定制数据集,采用深度学习算法,能可靠地识别异物位置与类别;采用服务器推流技术与终端进行数据交互,实现对远程设备的控制;客户段端采用VR+手机App技术,达到沉浸式视觉效果。多次实际测试结果表明:该系统实用性强,经济性好,准确率高,为铁路部门巡检体系提供良好的借鉴方案。Abstract: To address the problems of too many errors and omissions, high labor intensity and high cost in manual inspection, an aided inspection system for railway based on deep learning and VR remote control technology is designed. With the combination of open source datasets and customized datasets, the inspection system can identify the position and category of foreign objects reliably by adopting deep learning algorithms and uses server push stream technology to interact with the terminals to achieve control over remote devices. And VR + mobile App technology is used on the client to achieve immersive visual effects. The results of actual tests prove that the system is practical, economical, and accurate, providing a good solution as reference for the inspection system of railway.

-

Keywords:

- aided inspection /

- deep learning /

- remote control /

- foreign object detection model /

- VR

-

随着我国铁路高速发展,安全隐患逐渐增加,定期巡检、及时排查故障和安全隐患愈加必要。目前,巡检主要依赖人工目测,难以保证巡检质量,且占用大量人力[1]。

随着人工智能的兴起和计算机图像处理技术的日渐成熟,机器视觉和虚拟现实在很多领域得到应用,采用机器视觉等前沿技术的铁路巡检系统正在成为趋势。张毅[2]针对接触网巡检图像定位器缺陷检测的问题,提出一种基于图像深度表示和直线检测的目标检测一体化算法。何玉娟等人[3]分析铁路隧道漏缆巡检维护的现状及发展趋势,提出利用射频识别(RFID)技术辅助定位的视频巡检方案。张德光等人[4]研究开发一种铁路电务智能巡检机器人,解决高速铁路区间信号中继站监测的漏报、误报问题。王留军等人[5]通过实时视频采集和判别,实现钢轨、轨枕、扣件等轨道主要部件相关缺陷的快速检测。

目前,在以排查异物为主的铁路线路巡检方面,采用深度学习技术的相关研究尚不多见。本文基于深度学习开源模型YOLO,设计了一个铁路辅助巡检系统,通过修改YOLO模型最后一个卷积层的卷积核数,将模型迁移到定制数据集上,利用虚拟现实(VR)视觉和服务器推流技术,实时远程视频监测铁路异常状况,并以第1视角获得沉浸式体验,以期利用深度学习,达到人机协调、高效巡检的效果,推动传统人工异物排查作业模式向智能化发展。

1 系统构成及工作过程

1.1 系统构成

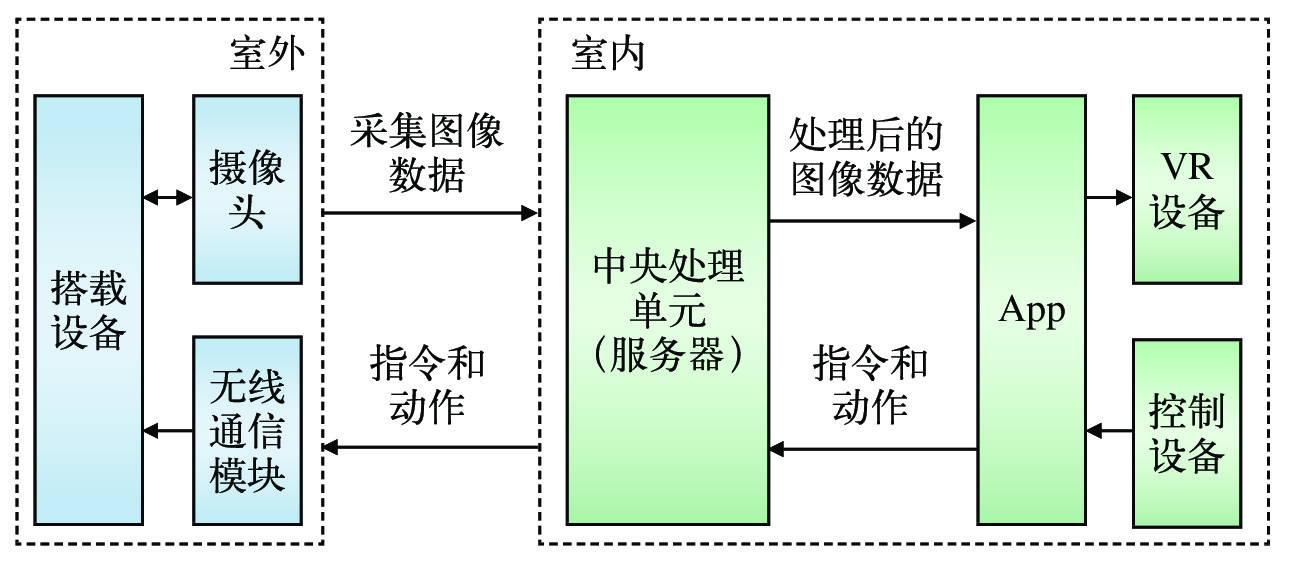

铁路辅助巡检系统由室外和室内2部分组成:室内部分由App软件和中央处理单元、控制设备、VR设备等硬件构成;室外部分包括摄像头、搭载设备和无线通信模块。系统结构如图1所示。

1.2 系统工作过程

系统主要工作过程简述如下:

(1) 系统启动后,摄像头采集数据,利用服务器推流技术,将数据上传到服务器;(2)使用深度学习算法对所采集的数据进行异物检测,标识出异物的位置与类别;(3)将带识别结果的视频流实时传送到用户App端,实现VR视觉显示效果;(4)通过方向传感器,使摄像头视角跟随用户视角同步切换,用户根据巡检情况做出判断,命令控制设备将动作指令发送到服务器,搭载设备从服务器获取指令并执行动作。

2 辅助巡检关键技术

2.1 基于深度学习的异物识别技术

2.1.1 数据集定制

定制铁路异物检测数据集是为了使模型对铁路环境下异物识别达到一定的精度和速度。定制的铁路异物检测数据集由开源数据集VOC2007中1000张图片和根据铁路周边常见异物拍摄的约3000张图像组成。对拍摄图片的物体边框、类别等必要信息进行统一标注,受限于人力和时间,仅收集了14类常见铁路异物图像,包括纸张、塑料袋、卡车、石块等,如图2所示。

2.1.2 实时异物检测方法

异物检测问题可视为深度学习领域中的物体检测问题。物体检测问题主要有2类方法:one-stage detection和two-stage detection。one-stage detection类方法具有低时延和较高精度,适合处理需要实时监测的问题,而two-stage detection类方法具有很高精度,但检测时间非常长,适用于对实时性要求不高的场景。

考虑到需要对画面中异物进行实时检测,选择one-stage detection类方法中具有代表性的YOLO开源模型[6-7],利用其开源的模型参数作为预训练模型,利用定制数据集对模型进行拟合和微调。

2.1.3 异物检测模型结构

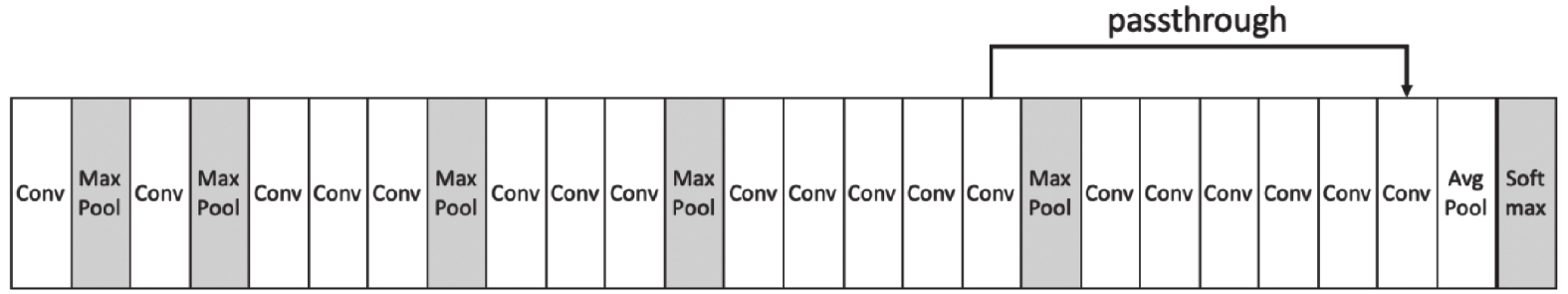

异物检测模型共使用19个卷积层和5个最大池化层提取图片特征。通过残差网络(ResNet)的跳跃式连接,提高了模型对细粒度物体的检测率;再利用一个卷积层进一步提取融合特征,通过全局平均池化后,使用softmax函数输出分类结果,达到识别目的。该模型的结构如图3所示。

2.1.4 模型训练

模型训练分为3步:(1)将模型最后一层卷积层之前的各层全部冻结,用224×224分辨率的图像对参数拟合5个epoch;(2)将冻结的层全部解冻,再用224×224分辨率的图训练15个epoch;(3)使用448×448分辨率的图对模型训练20个epoch。

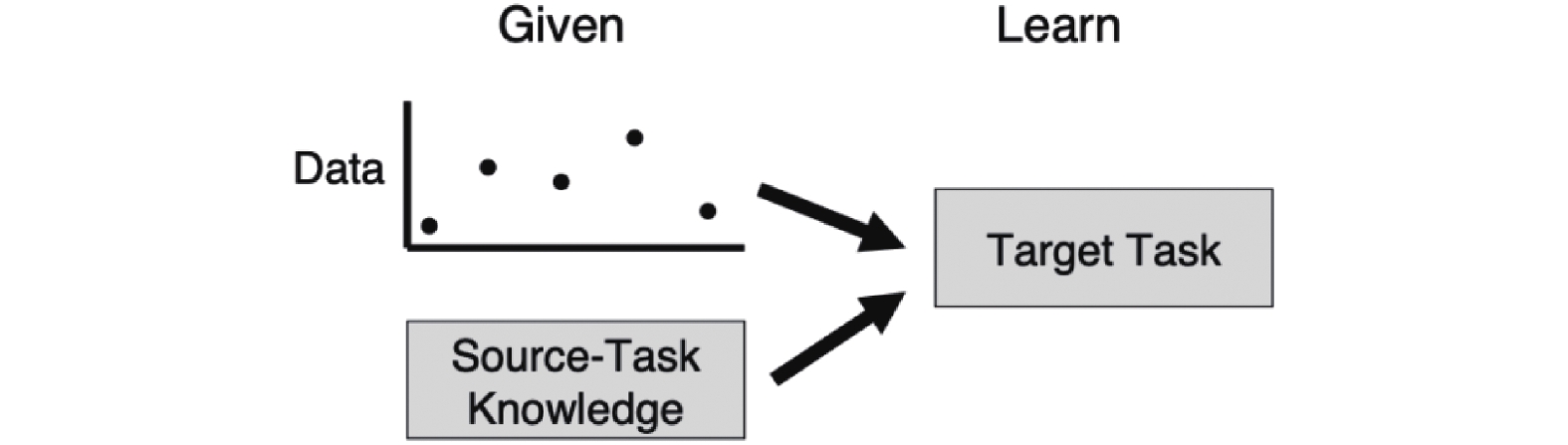

为加快模型训练速度和提升模型的检测质量,通过迁移学习对模型进行拟合。迁移学习[8]的过程如图4所示,在学习任务A时,可获得一定的相关知识经验,当学习另一个相似的任务B时,可以快速将经验应用于新问题。

2.2 基于服务器推流的可视化VR远程控制技术

铁路辅助巡检系统基于C/S架构,通过以太网通信实现服务器与客户端之间的数据交互,图像和控制指令分别通过2个通道独立传输。

图像传输过程为:搭载设备接收远程访问命令后,摄像头将画面实时传输给服务器,经算法处理后转发至VR端,VR端接收并解析处理服务器回应的最新Http报文,通过VR显示插件显示监测图像。

控制指令传输过程为:手机的方向传感器捕捉用户头部动作,将其转化为摄像头的角度旋转指令后,发送给控制设备,使摄像头与用户转头动作同步。可视化远程控制[9]所依托的服务器推流技术[10]可保证在服务器发送批量数据的同时,客户端能继续接收数据。

3 实验分析

3.1 室内实验分析

3.1.1 异物识别模型实验结果分析

实验室环境的相关软件配置包括Ubuntu16.04系统、CUDA 10.0.130、cuDNN 7.6.3,Python 3.6.8、TensorFlow 1.15.0、Keras 2.2.4;相关硬件配置包括NVIDIA GeForce RTX2080Ti显卡、AMD Ryzen 5 2600X Six-Core Processor处理器、16 GB运行内存。

以IoU取值为0.5时的平均精度均值(mAP)作为评价指标,测试数据集上mAP计算结果为64.5,AP值见表1。结果表明:在保持模型对VOC数据集中5个类别精度差别不大的情况下,对定制图像数据也具有较高的精度。

表 1 AP值计算结果类名 AP 类名 AP 类名 AP mAP 人物 84.3 塑料袋 41.6 衣物 53.3 64.5 石块 63.7 废纸 43.7 橡胶 64.1 猫 91.2 金属 63.5 电子类产品 71.4 狗 89.2 木材 67.3 陶瓷 57.9 鸟 72.4 鞋类 86.3 泥土 73.4 瓶子 53.1 食物残余 45.8 玻璃 54.4 电池 48.3 3.1.2 远程巡检控制实验结果分析

在室内较理想情况下,搭载设备(本实验中采用小车)与网关间距50 m,测试20组数据,每组间隔15 min,共进行90 min,记录其中3组的平均帧数和时延数据,见表2。经测试发现:随着测试时间推移,2类数据都仅在小范围内波动,验证该系统性能较为稳定,可实现流畅的远程控制。

表 2 平均帧数和平均时延测试数据测试时间/min 平均帧数/fps 20组数据

平均值平均时延/ms 20组数据

平均值第1组 第2组 第3组 第1组 第2组 第3组 0-15 13.98 13.78 15.2 14.6 145.5 142.9 140.7 132 15-30 15.09 14.15 14.51 131.1 128.7 140.4 30-45 14.04 14.41 15.51 143.0 136.9 142.6 45-60 14.27 14.18 14.73 133.9 139.8 134.1 60-75 15.15 14.7 14.88 144.3 140.7 132.4 75-90 13.58 14.04 16.31 140.3 143.9 145.9 平均值 14.53 15.61 15.52 135.1 145.4 135.0 3.2 室外基地系统测试

室外测试的目的是验证该系统的可行性、异物识别的准确性以及室外无线传输的稳定性。

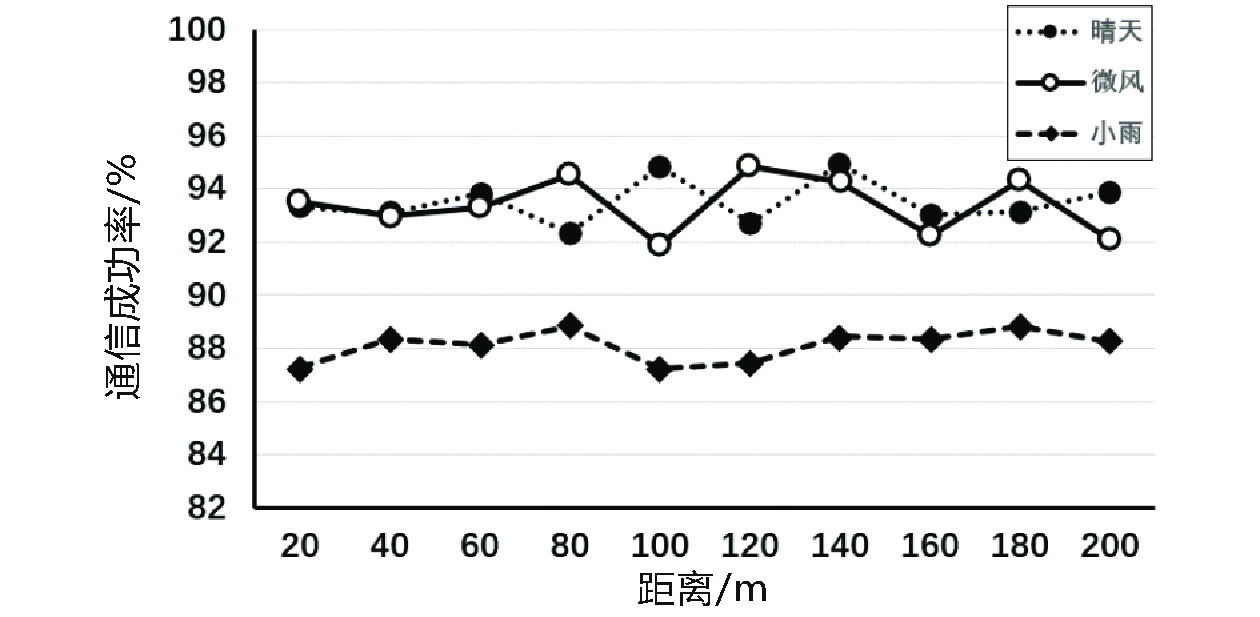

利用履带小车作为搭载设备,在校园局域网(模拟5G)环境下,使用校内铁路实习基地总长为200 m的铁道进行测试。将10类100个异物随机投放到铁道沿线,利用手柄、App及VR设备,远程控制小车沿轨道线路进行实时可视化巡检。分别在晴天、微风、小雨3种天气下,按不同传输距离分别进行20次测试,记录所识别的异物个数、种类及通信完成情况,最终平均检测到10类83个异物,通信完成情况的测试结果见图5所示。

测试结果表明:系统控制正常,VR画面基本流畅,铁道沿线放置的主要异物均可被识别;同时,在10组不同距离下,异物识别的成功率波动变化不大,晴朗天气下通信成功率为93.5%,微风条件下通信成功率为93.3%,即便在小雨条件下,通信成功率依然能保持在88.1%。

在此基础上,再对小车与人工配合巡检以及人工单独巡检分别进行20组测试,结果发现辅助巡检系统的平均漏检率仅为3%,而单纯人工巡检平均漏检率为13%,可见辅助巡检的效果显著。

4 结束语

综合考虑人工巡检和传统机器学习在工程上应用的优缺点,利用无线通信技术和深度学习算法的优势,建立铁路辅助巡检系统。实验表明:该系统对铁路巡检中异物排查具有良好的辅助效果,与人工方式相比,异物检测更为细致、准确,漏检更少,且更经济。

今后可尝试将YOLO的Backbone网络结构替换为ResNet、ThunderNet、ShuffleNet、EfficientNet等轻量级网络结构,以获得更高实时性和精度。随着辅助巡检模型和搭载设备的进一步完善和健全,该项技术还可更广泛地应用于诸如隧道漏缆安全巡检、轨道磨损检查等更多方面。另外,在实际巡检中可搭载无人机、综合巡检车等视野更广阔的设备,以降低巡检的漏检率。还可以利用5G低时延的特点,实现不限距离的通信,并获得更高实时性。

-

表 1 AP值计算结果

类名 AP 类名 AP 类名 AP mAP 人物 84.3 塑料袋 41.6 衣物 53.3 64.5 石块 63.7 废纸 43.7 橡胶 64.1 猫 91.2 金属 63.5 电子类产品 71.4 狗 89.2 木材 67.3 陶瓷 57.9 鸟 72.4 鞋类 86.3 泥土 73.4 瓶子 53.1 食物残余 45.8 玻璃 54.4 电池 48.3 表 2 平均帧数和平均时延测试数据

测试时间/min 平均帧数/fps 20组数据

平均值平均时延/ms 20组数据

平均值第1组 第2组 第3组 第1组 第2组 第3组 0-15 13.98 13.78 15.2 14.6 145.5 142.9 140.7 132 15-30 15.09 14.15 14.51 131.1 128.7 140.4 30-45 14.04 14.41 15.51 143.0 136.9 142.6 45-60 14.27 14.18 14.73 133.9 139.8 134.1 60-75 15.15 14.7 14.88 144.3 140.7 132.4 75-90 13.58 14.04 16.31 140.3 143.9 145.9 平均值 14.53 15.61 15.52 135.1 145.4 135.0 -

[1] 常 江. 巡道车视频检测系统的设计及关键技术的实现[D]. 北京: 北京交通大学, 2009. [2] 张 毅. 深度学习在接触网定位器缺陷检测中的应用 [J]. 铁路计算机应用,2018,27(3):15-19. DOI: 10.3969/j.issn.1005-8451.2018.03.004 [3] 何玉娟,宋 鑫,李 斌. 基于RFID定位的铁路隧道漏缆视频巡检方案 [J]. 中国铁路,2018(11):104-108. [4] 张德光,郑 勇,任 翔, 等. 高速铁路区间无人值守中继站智能巡检系统实现方案 [J]. 铁道通信信号,2019,55(2):7-11. [5] 王留军,张 鹰. 基于机器视觉的车载式铁路轨道智能巡检系统研究 [J]. 成都信息工程大学学报,2016,31(2):185-189. DOI: 10.3969/j.issn.1671-1742.2016.02.012 [6] Joseph Redmon, Santosh Divvala, Ross Girshick, et al. You Only Look Once: Unified, Real-Time Object Detection[C]//IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, NV, 2016: 779-788.

[7] Joseph Redmon, Ali Farhadi. YOLO9000: Better, Faster, Stronger[C]//IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, HI, 2017: 7263-7271.

[8] Sinno Jialin Pan, Qiang Yang. A Survey on Transfer Learning [J]. IEEE Transactions on Knowledge and Data Engineering (TKDE), 2010, 22(10): 1345-1359. DOI: 10.1109/TKDE.2009.191

[9] 张 晶, 贠 超,付 波. 安防机器人中手机可视化远程控制技术研究 [J]. 控制工程,2012,19(S1):12-14. [10] 孙 恒. 基于云服务的移动视频直播系统的设计与实现 [J]. 现代教育技术,2017,27(12):121-126. DOI: 10.3969/j.issn.1009-8097.2017.12.019

下载:

下载: