Railway foreign object intrusion limit tracking method based on correlation filtering

-

摘要:

针对铁路异物侵限频繁发生导致的列车运行安全问题,提出一种基于背景感知相关滤波器的铁路异物侵限跟踪方法。利用方向梯度直方图(HOG,Histogram of Oriented Gradient)特征提取铁路侵限异物自身特征,结合剪裁矩阵,以增加视频帧中实际背景的负样本;使用交替方向乘子法(ADMM,Alternating Direction Method of Multipliers)训练背景感知相关滤波器,减少计算复杂度,在保证跟踪速度的前提下,提升跟踪侵限异物的准确性,从而适应铁路沿线环境中由于侵限异物的形变、快速移动或天气等原因造成的目标丢失及跟踪框漂移等情况。实验结果表明,该方法对铁路侵限异物的跟踪精确度和AUC(Area Under Curve)值分别达到93%和71.9%,均高于SRDCF、KCF、ASLA和CSK等算法,具有更好的准确性。

-

关键词:

- 铁路异物侵限 /

- 跟踪方法 /

- 相关滤波 /

- 方向梯度直方图(HOG)特征 /

- 剪裁矩阵

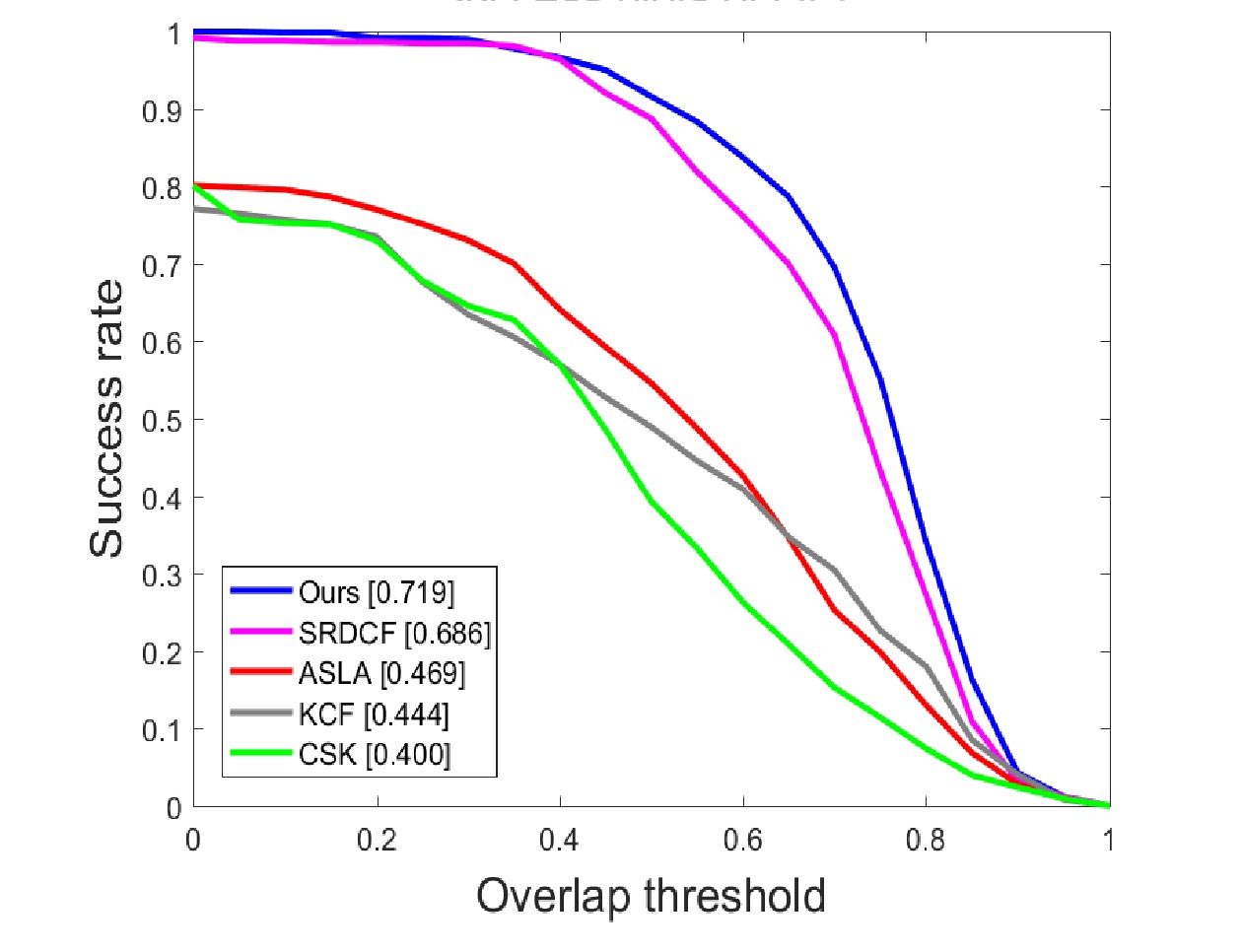

Abstract:This paper proposed a railway foreign object intrusion limit tracking method based on background perception correlation filters to address the safety issues of train operation caused by frequent foreign object intrusion limit in railways. The paper utilized the HOG (Histogram of Oriented Gradient) feature extraction to extract the characteristics of railway intrusion foreign objects, and combined it with the clipping matrix to increase the negative samples of the actual background in the video frame, used the ADMM (Alternating Direction Method of Multipliers) to train background perception related filters model, reduce computational complexity and improving the accuracy of tracking intruded foreign objects while ensuring tracking speed, thus adapted to the situations of target loss and tracking frame drift caused by deformation, rapid movement or weather of intruded foreign objects in railway environments. The experimental results show that the tracking accuracy and AUC (Area Under Curve) value of this method for railway intrusion foreign objects reach 93% and 71.9%, respectively, which are higher than algorithms such as SRDCF, KCF, ASLA, and CSK, and have better accuracy.

-

在铁路运输中,铁路沿线环境的安全尤为重要。铁路侵限异物包括人、动物、风筝和气球等,这些异物进入限界内可能会对受电弓或接触网造成影响。因此,亟需研究一种在铁路沿线环境中对侵限异物有效跟踪的方法。

既有的铁路异物侵限监测方式分为两类,即传感器式检测[1-2]和机器视觉[3-6]。传感器式检测中的接触式检测方法成本较低,安装结构简单,但对体积较小且未与接触网接触的侵限异物易产生漏检,此外,其对移动中的侵限异物的监测也有一定的局限性;机器视觉方法自动化程度较高,将其应用至铁路沿线环境中可较好地对侵限异物进行跟踪。

基于相关滤波和深度学习的铁路侵限异物跟踪均属于机器视觉方法中的判别类模型[7-9],前者使用滤波模板与目标候选区域作相关运算,当前视频帧里的目标实际位置即为运算最大响应输出;后者基于深度学习的跟踪方法,利用循环神经网络、孪生网络等方式实现目标精确跟踪[10-11],某些深度学习算法计算量较大、时效性较弱,且须利用GPU计算资源以实现较好性能,在只配备通用的CPU设备中较难实现原有的性能。

因此,本文使用一种基于背景感知相关滤波器的铁路异物侵限跟踪方法,对侵限异物进行跟踪。该方法可减少相关滤波算法计算复杂度,提高运算效率及跟踪准确性,实现在铁路复杂场景下对侵限异物的有效跟踪。

1 相关滤波算法基本原理

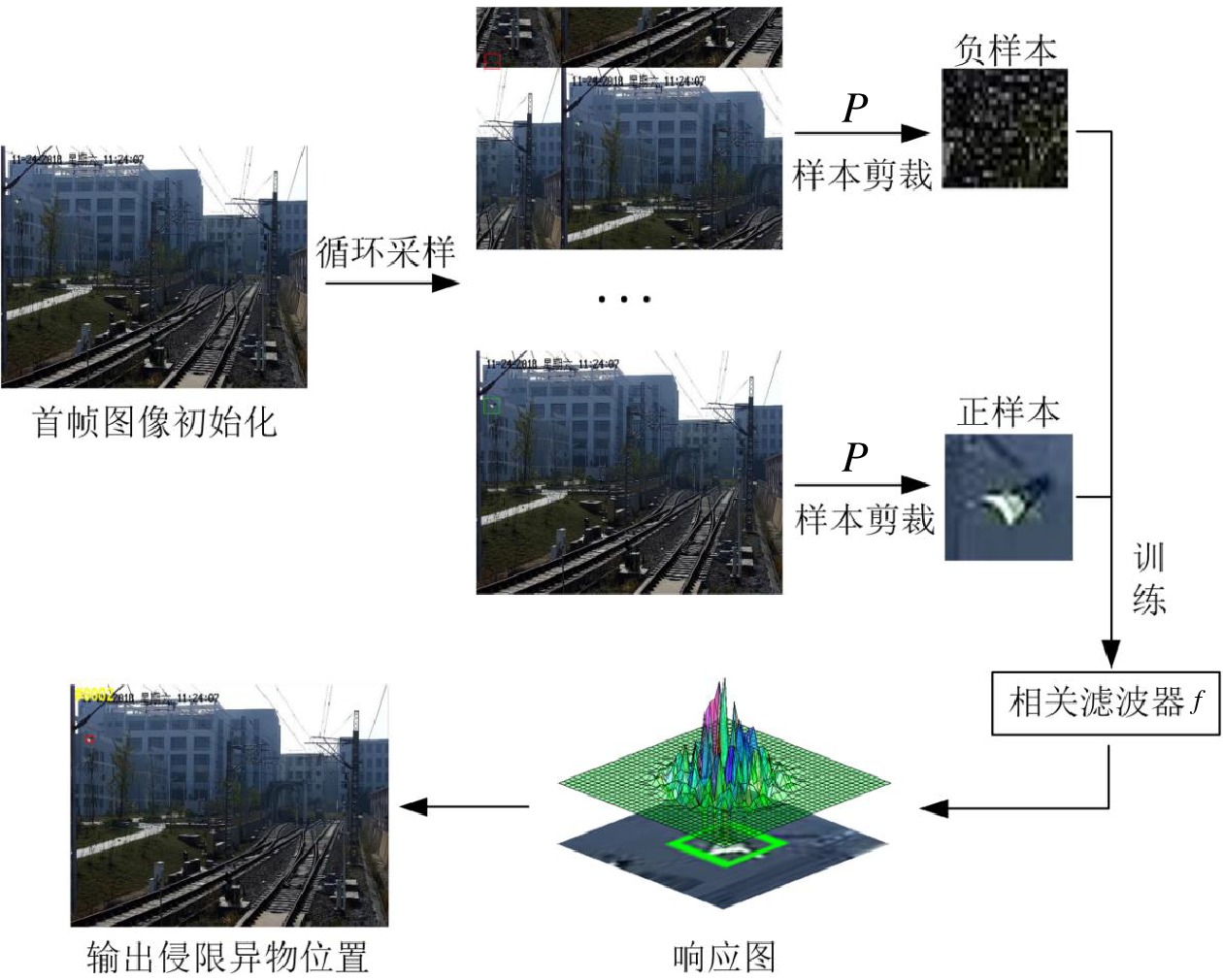

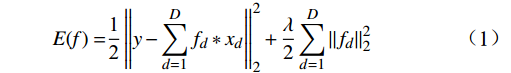

越相似的两个信号相关性就越高,当相关滤波应用于跟踪领域中,便转化为滤波器与输入图像之间的相关性。使用背景感知相关滤波器的铁路异物侵限跟踪方法是对初始帧进行循环位移,构建目标样本,并训练得到相关滤波器,运用滤波器与下一帧中的待检测区域进行卷积操作,得出的响应图中的最大响应值即为当前帧铁路侵限异物的位置。基于相关滤波的铁路侵限异物跟踪方法在于最小化如公式(1)所示的目标函数,求解滤波器f。

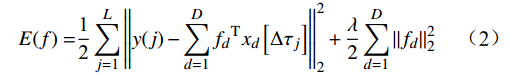

$$ \mathit{{E(f) = }}\frac{\text{1}}{\text{2}} \left\| y-\sum\limits_{d=1}^Df_d*x_d \right\| _2^2+\frac{\lambda}{2}\sum\limits_{d=1}^D \left\| f_d \right\| _2^2 $$ (1) 式(1)中,λ为正则化系数;*为卷积操作;L为目标维度;y ∈ RL为期望的相关响应;D为特征通道数;fd为第d个特征通道的滤波器模板;xd ∈RL为第d个特征通道的矢量图像。将公式(1)用空间域表达为脊回归目标函数形式,为

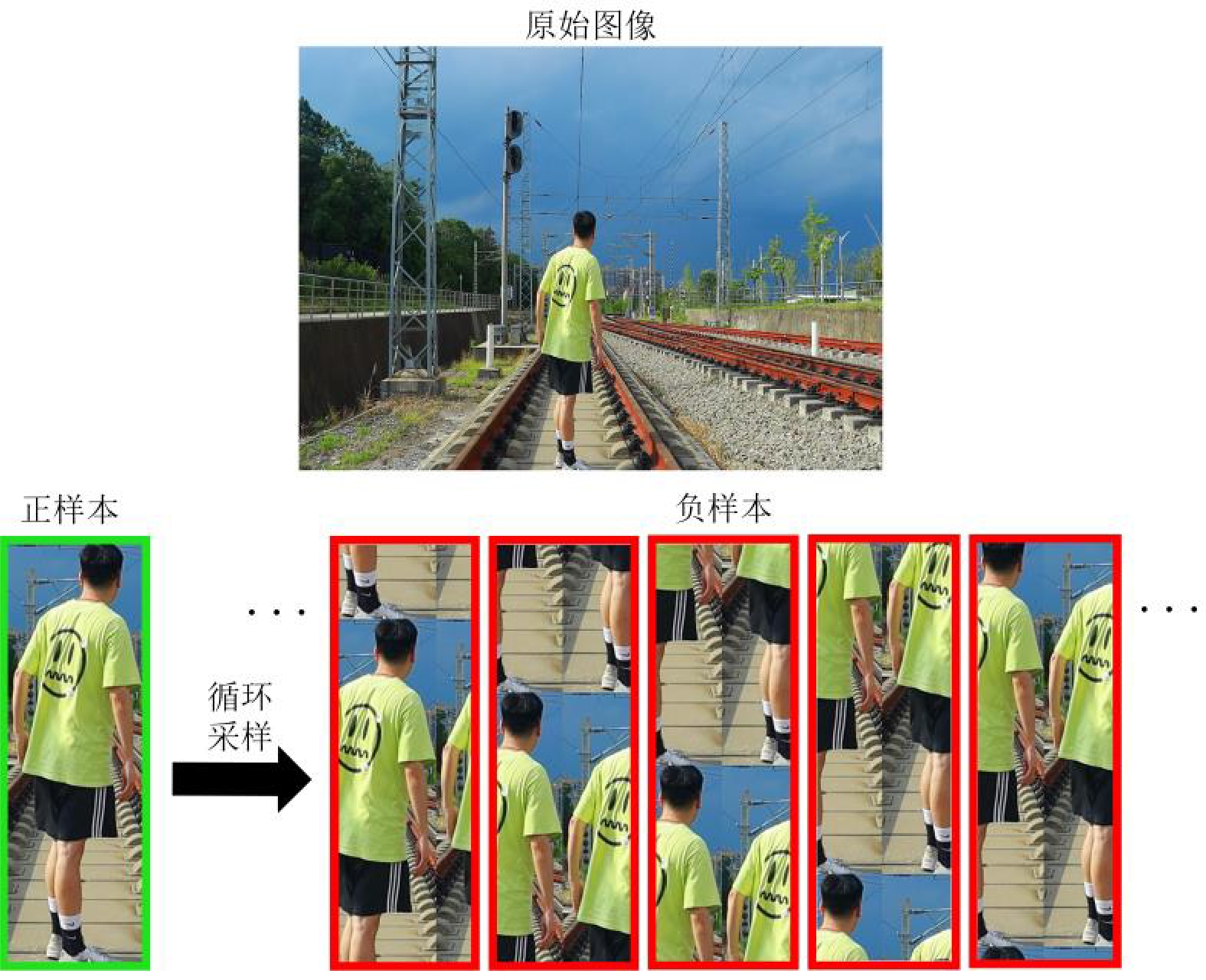

$$ {{E(f) = }}\frac{{\text{1}}}{{\text{2}}}\sum\limits_{j = 1}^L {\left\| {y(j) - \sum\limits_{d = 1}^D {{f_d}^{\rm T}{x_d}} \left[ {\Delta {\tau _j}} \right]} \right\|_2^2 + \frac{\lambda }{2}\sum\limits_{d = 1}^D {\left\| {{f_d}} \right\|} _2^2} $$ (2) 式(2)中,y(j)为第j个维度的期望响应;[∆τj]为循环位移操作;xd[∆τj]则表示对xd的第j次循环位移操作;T为转置运算符号。公式(2)所描述的是将一个以侵限异物为中心的图像作为正样本,其余经过侵限异物进行循环位移操作的图像作为负样本,如图1所示。

通过上述方式训练的滤波器可将侵限异物从其自身循环位移操作后的图像中分离。根据循环位移操作方法能让样本数量增加,且根据循环矩阵对角化,从频域中计算,可减少计算量,从而提升铁路侵限异物跟踪的速度。但此方法也存在一定的缺点,通过循环位移增加的样本存在边界效应,经过循环采样会丢失部分真实背景信息,且负样本较为单一,限制滤波器从实际背景中得到真实的侵限异物位置,降低了跟踪的性能。因此,需要使用较多的真实背景样本来训练铁路侵限异物滤波器。

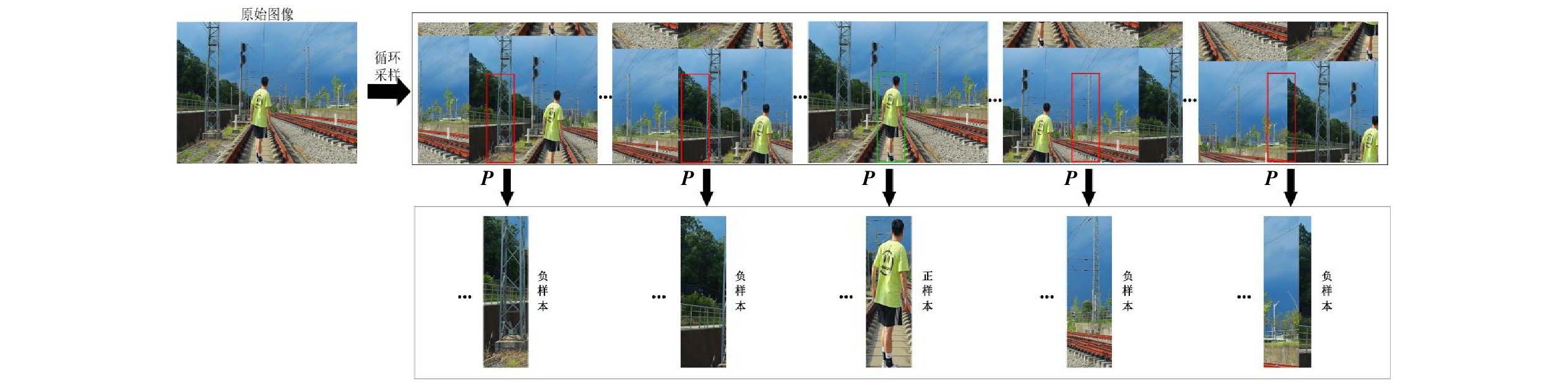

2 基于背景感知相关滤波器的铁路异物侵限跟踪方法

针对经过循环位移增加样本导致的边界效应问题,本文使用基于背景感知相关滤波器的铁路异物侵限跟踪方法,对侵限异物进行跟踪。使用P剪裁矩阵,得到高质量样本,利用P矩阵剪裁得出的目标样本和图像背景信息来训练背景感知相关滤波器,在增加样本数量的同时,改善背景信息的丢失问题,从而提高跟踪性能。其原理如图2所示。

2.1 侵限异物特征提取

基于背景感知的相关滤波使用方向梯度直方图(HOG,Histogram of Oriented Gradient)特征,即运用初始帧中跟踪框内的铁路侵限异物进行HOG特征的提取,为之后训练滤波器使用。HOG特征使用初始帧局部信息提取侵限异物特征,因此性能较稳定,对光照、遮挡和几何变化有一定的抗干扰性。

HOG特征的提取步骤包括图像灰度化处理、归一化处理、梯度计算、每个像素的梯度直方图投影、对每个重叠块(block)内的单元(cell)进行对比度归一化、将所有block内直方图向量组成一个HOG特征向量等。HOG特征提取可视化示意如图3所示。

2.2 背景感知相关滤波器

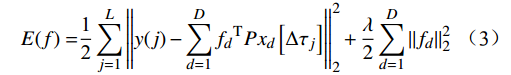

在基于背景感知的相关滤波算法中,通过最小化公式(3),求解背景感知相关滤波器。

$$ {{E(f) = }}\frac{{\text{1}}}{{\text{2}}}\sum\limits_{j = 1}^L {\left\| {y(j) - \sum\limits_{d = 1}^D {{f_d}^{{\rm{T}}}P{x_d}} \left[ {\Delta {\tau _j}} \right]} \right\|_2^2 + \frac{\lambda }{2}\sum\limits_{d = 1}^D {\left\| {{f_d}} \right\|} _2^2} $$ (3) 式(3)中,扩大采样区域后xd的大小用N表示,剪裁矩阵P是L×N 的二值矩阵,其中,L是目标维度,且L≪ N。通过使用P 对循环位移产生的样本进行剪裁,如图4所示,在增加样本数量的同时,可有效去除正样本中的干扰信息,得到的负样本中也包含大量的除铁路侵限异物外的真实背景信息。

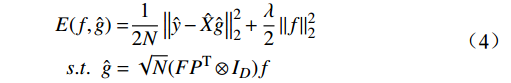

根据循环样本的频域快速求解的特性,将公式(3)转换至频域,并根据帕斯瓦尔定理,表示为

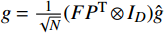

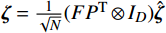

$$ \begin{gathered} {{E(f, {\hat g}) = }}\frac{{\text{1}}}{{{{2N}}}}\left\| {\hat y - \hat X\hat g} \right\|_2^2 + \frac{\lambda }{2}\left\| f \right\|_2^2 \\ \begin{array}{*{20}{c}} {s.t.} \end{array}\hat g = \sqrt N (F{P^{\rm{T}}} \otimes {I_D})f \\ \end{gathered} $$ (4) 式(4)中,^为离散傅里叶变换;

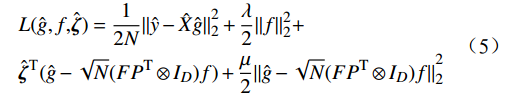

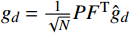

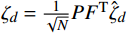

$ {{\hat g}} $ 是辅助变量;$ \hat X $ =[diag${({\hat x_1})^{{\rm{T}}}}$ ,···,diag${({\hat x_D})^{\rm{T}}}$ ];f和$ {{\hat g}} $ 是DL×1和DN×1维的各通道特征的元素集合,其中,f=[$f_1^{\rm{T}}$ ,···,$f_D^{\rm{T}}$ ],$ \hat g $ =[$g_1^{\rm{T}}$ ,···,$g_D^{\rm{T}}$ ];ID是D×D维的单位矩阵;$ \otimes $ 为Kronecker乘积运算符;F是N×N大小的离散傅里叶变换矩阵;设新的滤波器为gd=PTfd。构造增广拉格朗日函数,公式为$$\begin{aligned} &L({\hat g ,f,}\hat{{\boldsymbol{\zeta}} })=\frac{1}{2{N}}{\Vert {\hat y }-{\hat X \hat g }\Vert }_{2}^{2}+\frac{\lambda }{2}{\Vert {f}\Vert }_{2}^{2} +\\ &{\hat {\boldsymbol{\zeta} }}^{\text{T}}({\hat g}-\sqrt{{N}}({{FP}}^{{{\rm{T}}}}\otimes {{I}}_{{D}}){f}) +\frac{\mu }{2}{\Vert {\hat g}-\sqrt{{N}}({{FP}}^{{{\rm{T}}}}\otimes {{I}}_{{D}}){f}\Vert }_{2}^{2} \end{aligned} $$ (5) 式(5)中,

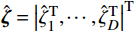

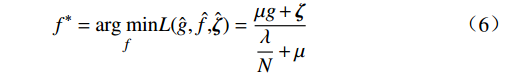

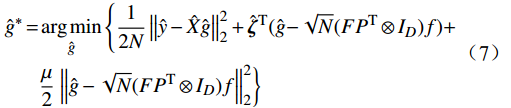

$ \hat {\boldsymbol{\zeta}} $ 是傅立叶域中大小为DN×1的拉格朗日向量,$\hat {\boldsymbol{\zeta}} ={\left| {\hat \zeta _1^{{\rm{T}}},\cdots,\hat \zeta _D^{{\rm{T}}}} \right|^{\rm{T}}}$ ,μ为惩罚因子。使用交替方向乘子法(ADMM,Alternating Direction Method of Multipliers)对公式(5)中的f和$\hat g $ 进行优化,得$ {f^*} $ 和$ {{\hat g}^*} $ ,公式为$$ f^*=\underset{f}{\mathrm{arg}\;\mathrm{min}}L({\hat g ,\hat f,}\hat{{\boldsymbol{\zeta}} }) =\frac{\mu g+{\boldsymbol{\zeta}} }{\dfrac{\lambda }{N}+\mu } $$ (6) $$ \begin{aligned} {{\hat g}^*} =& \mathop {\arg \min }\limits_{\hat g} \left\{ {\frac{1}{{2N}}\left\| {\hat y - \hat X\hat g} \right\|_2^2} + {{\hat {\boldsymbol{\zeta}} }^{{{\mathrm{T}}}}}({{\hat g}} - \sqrt {{N}} ({{F}}{{{P}}^{{{\mathrm{T}}}}} \otimes {{{I}}_{{D}}}){{f}}) +\right. \\ &{ \frac{\mu }{2}} \left. {\left\| {{{\hat g}} - \sqrt {{N}} ({{F}}{{{P}}^{{{\mathrm{T}}}}} \otimes {{{I}}_{{D}}}){{f}}} \right\|_2^2} \right\} \end{aligned} $$ (7) 式(6)中,

$ g = \frac{1}{{\sqrt N }}(F{P^{\mathrm{T}}} \otimes {I_D})\hat g $ ;$ {\boldsymbol{\zeta}} = \frac{1}{{\sqrt N }}(F{P^{\mathrm{T}}} \otimes {I_D})\hat {\boldsymbol{\zeta}} $ 。单位矩阵Kronecker乘积运算符可分解为$ {g_d} = \frac{1}{{\sqrt N }}P{F^{\mathrm{T}}}{\hat g_d} $ 和$ {\zeta _d} = \frac{1}{{\sqrt N }}P{F^{\mathrm{T}}}{\hat \zeta _d} $ 的D个独立的快速傅里叶逆变换计算。2.3 滤波器更新策略

铁路侵限异物并非静止状态,受杂草、天气等环境及侵限异物自身旋转的影响,视频序列中的侵限异物目标难以被准确捕捉跟踪。因此,在得出滤波器后,需要对其进行不断更新,以适应环境变化,提升跟踪的准确性。使用拉格朗日系数更新,公式为

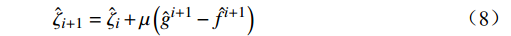

$$ {\hat \zeta _{i + 1}} = {\hat \zeta _i} + \mu \left( {{{\hat g}^{i + 1}} - {{\hat f}^{i + 1}}} \right) $$ (8) 采用ADMM迭代求解,

$ {{{\hat g}}^*} $ 和$ {{{\hat f}}^{\text{*}}} $ 的第i+1次迭代的解分别是$ {{{\hat g}}^{{\text{i}} + {\text{1}}}} $ 和$ {{{\hat f}}^{{\text{i}} + {\text{1}}}} $ 。同时,$ {\hat f^{i + 1}} = (F{P^T} \otimes {I_D}){f^{i + 1}} $ ;参数$ {\mu }^{(i+1)}=\mathrm{min}({\mu }_{\mathrm{max}},\beta {\mu }^{(i)}) $ ,其中,β=10,μmax=103。利用前一帧更新的滤波器检测下一帧的铁路侵限异物的实际位置;根据得出的响应图中的最大响应值,判定当前帧侵限异物的位置。

3 实验结果与分析

3.1 实验参数及评价指标

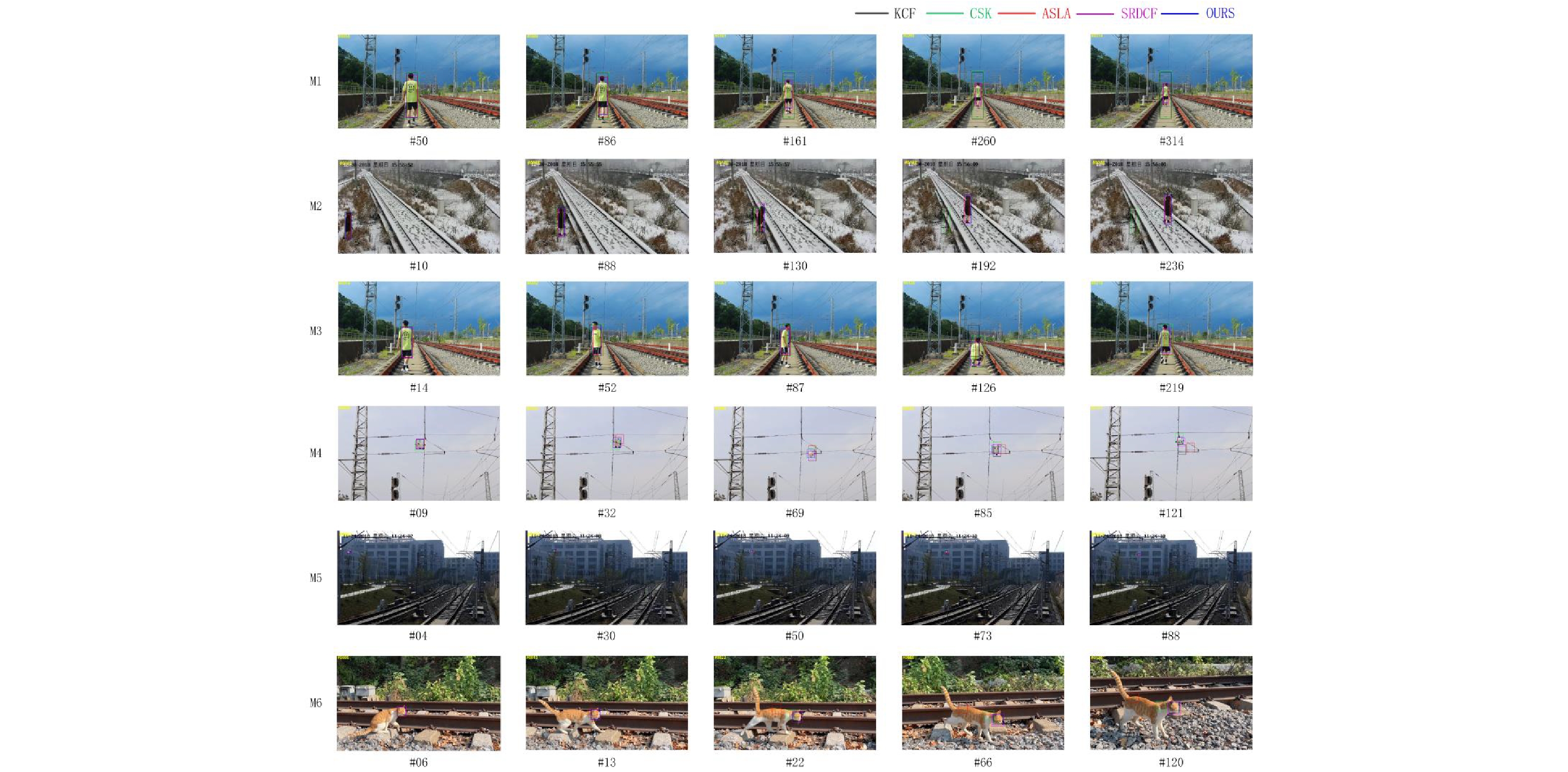

实验采用Intel(R) Core(TM) i5-8250U CPU,内存为8 G,并搭载Win10操作系统的计算机,软件工具为Matlab2017b。为验证本文方法在铁路异物侵限视频序列中的整体性能,在实验验证环节使用的视频序列均在某铁路试验沿线中拍摄,由帧率为25帧/s的高清网络球机和摄像机采集视频。拍摄不同属性的M视频序列,M1、M2为不同天气下的异物侵限视频序列,其中,M1有明显尺度变化;M3、M4中的侵限异物移动速度较快;M5、M6中的侵限异物有明显旋转形变。本实验将正则化系数λ设置为0.001,惩罚因子μ和ADMM迭代次数分别设置为1、2。

选用KCF(Kernelized Correlation Filters)、SRDCF(Spatially Regularized Discriminative Correlation Filter)、ASLA(Adaptive Structural Local Sparse Appearance)和CSK(Circulant Structure Kernel)等典型相关滤波算法与本文方法的性能进行比较,通过定量和定性评估,分析不同算法在铁路环境场景中跟踪性能的差异。选择对象跟踪基准 ( OTB,Object Tracking Benckmark)中的一次性评估(OPE,One Pass Evaluation)对算法综合性能进行评估,基于精确度图、精确度数值和成功率图、成功率图曲线下面积(AUC,Area Under Curve)分析各算法跟踪侵限异物的准确性。

3.2 算法定量评估

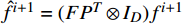

分别将KCF、SRDCF、ASLA、CSK和本文使用的方法在不同属性的M视频序列下跟踪铁路中的侵限异物,绘制OPE(One-Pass Evaluation)跟踪精确度曲线和成功率曲线进行定量评估,如图5和图6所示。图5中,横坐标为位置误差阈值,纵坐标为精度;图6中,横坐标为重叠阈值,纵坐标为成功率。

由图5和图6可知,本文方法精度值和AUC值分别为93%和71.9%,均优于其他算法。对于在损失函数中引入惩罚项,使用Gauss-Seidel方式迭代求解的SRDCF算法,算法精度值和AUC值达89.8%和68.6%,略低于本文方法,且计算速度较低,无法满足实时跟踪需求。由于视频帧中侵限异物有尺度变化、旋转和快速移动等属性,使得本文方法的精度值和AUC分别高出KCF算法42.5%和27.5%。基于结构化局部稀疏模型的ASLA算法[12],以及使用循环矩阵的CSK算法的精度值分别为52.5%、46.9%,AUC值分别为47.2%和40%。

通过精度值与AUC得分对比得出,本文方法在铁路限界内环境下,对侵限异物跟踪的准确性更高。

3.3 算法定性评估

观察不同属性M视频序列下的KCF、SRDCF、ASLA、CSK和本文方法对铁路侵限异物的跟踪效果,可对算法进行定性评估,如图7所示。

视频序列M1和M2实验结果分析:M1中光照条件下,侵限异物的尺度有明显变化,无尺度估计的KCF算法和CSK算法的跟踪框不能及时根据侵限异物自身尺度的变化而变化,均在视频帧的第75帧左右无法适应侵限异物尺度变化导致跟踪效果较差,直到120帧和132帧后丢失目标。其余方法均能较好适应尺度变化。M2中背景环境为大雪大雾天气,正在下落的雪花会对视频图像清晰度造成一定干扰,侵限异物被杂草遮挡产生干扰,也有明显平面内的上下左右移动。针对此场景,ASLA算法在视频第49帧的跟踪框因遮挡问题有一定的漂移,后期也因侵限异物自身移动的问题使其跟踪框在第145帧开始持续漂移;在第123帧时,由于侵限异物自身的上下移动,KCF算法和CSK算法的跟踪框开始滞后,直到第136帧丢失目标,本文方法及SRDCF算法可以较好适应。

视频序列M3和M4实验结果分析:M3和M4中侵限异物自身均发生旋转,且M3中侵限异物有产生尺度变化。M3中KCF算法在第81帧丢失目标,在第112帧中CSK算法和ASLA算法的跟踪框产生明显漂移。M4中从第28帧开始,轻飘物发生旋转,导致ASLA算法和CSK算法跟踪框漂移。当轻飘物持续漂移,第69帧开始,除了本文方法没有产生跟踪框漂移外,其余算法的跟踪框均有不同程度的漂移。第119帧中,仅有本文方法实现了对侵限异物的准确跟踪。

视频序列M5和M6实验结果分析:M5和M6中针对侵限异物的快速移动,不同算法表现也有所不同,M5中轻飘物风筝的快速移动和在第28帧树木对异物的遮挡使KCF算法丢失跟踪目标,在第92帧中,由于自身旋转加目标的快速移动,使SRDCF算法在第92帧丢失目标,除本文方法外,其余算法跟踪框均有漂移。M6中由于动物的快速移动使ASLA算法和CSK算法在第16帧中丢失目标,其余算法跟踪框也均在后续异物的快速移动中逐步漂移。

综上得出,本文方法能更好适应铁路限界内的复杂环境,对产生形变、旋转和遮挡等侵限异物进行准确有效跟踪,且速度能达到52 FPS,满足实时跟踪需求。

4 结束语

本文设计基于背景感知相关滤波器的跟踪方法对铁路侵限异物进行跟踪,提取对光照和几何变化有抗干扰性的侵限异物的HOG特征,并使用剪裁矩阵对移位样本进行剪裁,扩大搜索区域,增加包含实际背景信息的负样本,提高侵限异物跟踪的准确性。实验结果表明,本文方法在跟踪精确度和成功率方面均优于其他算法,实现在铁路限界内对侵限异物的有效准确跟踪。后续工作将着重于融合深度特征,进一步提高侵限异物跟踪方法的鲁棒性。

-

[1] 时佳斌. 三维激光异物侵限监测系统研究[J]. 铁道建筑,2021,61(8):141-143. DOI: 10.3969/j.issn.1003-1995.2021.08.32 [2] 孙 睿. 光纤布喇格光栅在高速铁路异物侵陷监测系统中的应用研究[J]. 信息通信,2012,25(6):19-20. [3] 李 航,彭高亮,林鸿钊,等. 基于传感器融合预测的改进跟踪前馈控制方法研究[J]. 红外与激光工程,2023,52(5):423-433. [4] 厍向阳,罗佳琪,任海青,等. 基于稀疏表示的相关滤波目标跟踪算法[J]. 计算机工程与应用,2023,59(11):71-79. DOI: 10.3778/j.issn.1002-8331.2202-0099 [5] Galoogahi H K, Fagg A, Lucey S. Learning background-aware correlation filters for visual tracking[C]//2017 IEEE International Conference on Computer Vision (ICCV), 22-29 October, 2017, Venice, Italy. New York, USA: IEEE, 2017: 1144-1152.

[6] Danelljan M, Häger G, Shahbaz Khan F, et al. Learning spatially regularized correlation filters for visual tracking[C]//IEEE International Conference on Computer Vision (ICCV), 7-13 December, 2015, Santiago, Chile. New York, USA: IEEE, 2015: 4310-4318.

[7] Henriques J F, Caseiro R, Martins P, et al. Exploiting the circulant structure of tracking-by-detection with kernels[C]//12th European Conference on Computer Vision, 7-13, December, 2012, Florence, Italy. Berlin, Germany: Springer, 2012: 702-715.

[8] 方 澄,路 稳,姬菁颖,等. 基于外观相似性更新的相关滤波跟踪算法[J]. 系统工程与电子技术,2022,44(1):117-126. DOI: 10.12305/j.issn.1001-506X.2022.01.16 [9] Henriques J F, Caseiro R, Martins P, et al. High-speed tracking with kernelized correlation filters[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 37(3): 583-596. DOI: 10.1109/TPAMI.2014.2345390

[10] Fan H, Ling H B. SANet: structure-aware network for visual tracking[C]//IEEE Conference on Computer Vision and Pattern Recognition Workshops (CVPRW), 21-26 July, 2017, Honolulu, HI, USA. New York, USA: IEEE, 2017: 2217-2224.

[11] Li B, Yan J J, Wu W, et al. High performance visual tracking with Siamese region proposal network[C]//2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR), 18-23 June, 2018, Salt Lake City, UT, USA. New York, USA: IEEE, 2018: 8971-8980.

[12] Jia X, Lu H C, Yang M H. Visual tracking via adaptive structural local sparse appearance model[C]//Proceedings of the 2012 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), 16-21 June, 2012, Providence, RI, USA. New York, USA: IEEE, 2012: 1822-1829.

下载:

下载: