Adversarial robust head detection model oriented to railway passenger transport scenes

-

摘要: 基于人头检测的人群数量估计算法能为铁路客运车站应对突发客流、防止人群聚集提供有效的决策辅助,但人头检测使用的深度学习模型易受到对抗样本影响。为提升深度学习模型的对抗鲁棒性,建立了基于RetinaNet算法的人头检测模型;在Brianwash数据集上分别使用快速梯度符号法(FGSM,Fast Gradient Sign Method)和投影梯度下降(PGD,Projected Gradient Descent)2种对抗攻击方法生成对抗样本,初始模型在对抗样本数据集上的mAP值均有显著下降,验证了对抗攻击对模型性能影响的有效性;再对模型进行对抗训练,对抗训练后的模型在各类对抗样本验证数据集上的mAP值均有显著提升。实验结果表明,对抗训练后的人头检测模型能有效防御对抗样本的攻击,提升模型检测性能和对抗鲁棒性。

-

关键词:

- 目标检测 /

- 对抗攻击 /

- 人头检测 /

- 图像处理 /

- 卷积神经网络(CNN)

Abstract: The crowd estimation algorithm based on head detection can provide effective decision-making assistance for railway passenger stations to cope with sudden passenger flow and prevent crowd aggregation, but the deep learning model used for head detection is easily affected by adversarial samples. To improve the adversarial robustness of deep learning models, this paper established a head detection model based on the RetinaNet algorithm. The paper used two adversarial attack methods, Fast Gradient Sign Method (FGSM)and Projected Gradient Descent (PGD), to generate adversarial samples on the Brianwash dataset. The initial model had a significant decrease in mAP on the adversarial sample dataset, was verified the effectiveness of adversarial attacks on model performance. After conducting adversarial training on the model, the mAP values of the trained model were significantly improved on various adversarial sample validation datasets. The experimental results show that the head detection model trained in adversarial training can effectively defend against attacks from adversarial samples, improve the model's detection performance and adversarial robustness. -

铁路客运车站进/出站口、检票口旅客人群密集程度较高,易造成旅客聚集效应,使旅客运输组织难度变大[1]。随着计算机视觉技术的发展,基于目标检测的人群密度估计算法可为车站突发客流监测、聚集人群疏导提供有效的决策辅助[2-4]。张秋亮等人[5]利用Faster-RCNN(Region Convolutional Neural Networks)算法设计了一种头肩检测模型,对客流密度和排队长度进行检测,并给出车站拥挤度评价方法;张泓等人[6]使用以ResNet101为特征提取网络的Faster-RCNN人头检测模型,统计监控摄像机下采集的复杂场景人群数量。

近年来有研究表明,深度学习模型易受到对抗攻击的影响[7],利用微小扰动生成的对抗图像,虽不会干扰人眼判断,却会干扰深度学习模型的预测结果,使模型性能下降。部分铁路客运业务需要经第三方客户端采集和上传图像,因此,存在不法分子上传对抗图像,进行恶意对抗攻击的情况。

提升深度学习模型对抗样本攻击防御能力的方式包括对抗样本检测和对抗训练[8]。对抗样本检测利用正常样本和对抗样本间的差异进行检测,实际使用中与深度学习模型进行串行或并行计算,会降低深度学习模型的推理速度或增加资源的消耗。对抗训练在深度学习模型训练过程中使用对抗样本,从而提高深度学习模型的鲁棒性,相比对抗样本检测减少了部署时的资源使用。本文基于RetinaNet算法设计了一种人头检测模型[9],对其进行对抗训练,研究对抗训练对检测模型鲁棒性的影响。

1 算法原理

1.1 对抗攻击方法

按照不同的攻击者能否获取目标检测模型的结构信息或参数,对抗攻击可分为白盒攻击和黑盒攻击。在白盒攻击条件下,攻击者能与目标检测模型交互,得到算法梯度信息;而黑盒攻击的攻击者只能得到目标检测模型的输入和输出。按攻击者攻击目的分类,对抗攻击可分为目标攻击和非目标攻击,区别在于前者使图片中同一类别的被检测物体被错误地分成另一类别,而后者不指定固定的出错类别。

对抗攻击方法按照不同的攻击原理,可分为基于梯度的单步攻击、迭代攻击和基于优化的攻击。单步攻击只对目标图像攻击1次;迭代攻击则按照一定的方式进行多次攻击;基于优化的攻击将寻找对抗样本看作一个优化问题,使用优化算法对其进行优化。

1.1.1 FGSM对抗攻击方法

快速梯度符号法(FGSM,Fast Gradient Sign Method)是Goodfellow 等人提出的一种以快速生成对抗样本为目标的单步白盒攻击方法[10]。该方法的核心思想是在

L∞ 范数下,沿着梯度的反方向对原始样本添加扰动,从而拉大对抗样本与原始样本间的距离。具体生成公式为˜x=x+ε⋅sign(∇xJ(θ,x,y)) (1) 式中,x为原始样本;ε为控制扰动大小的标量;

θ为 被攻击检测模型的参数;y为样本x的真实标签,J(θ,x,y) 为被攻击检测模型在参数为θ、 原始样本为x、标签为y时的损失函数;∇x 代表对损失函数求x的偏导;sign 表示取梯度向量的符号。最终,由原始样本加上扰动生成对抗样本˜x 。1.1.2 PGD对抗攻击算法

Kurakin等人[11]提出了基于FGSM算法的多次迭代生成扰动方法(BIM,Basic Iterative Methods)。该方法以较小的步长多次执行FGSM,并将扰动样本裁剪到一定范围。投影梯度下降 (PGD,Projected Gradient Descent) 算法在BIM基础上增加了一个随机噪声初始化扰动,并将每一步产生的样本作为下一步的输入[12]。PGD是攻击性最强的迭代攻击算法之一,具体生成公式为

˜xt+1=∏x+S(˜xt+α⋅sign(∇xJ(θ,x,y))) (2) 式中,

α 为控制扰动大小的标量;对抗样本˜xt+1 由前一步的样本˜xt 加上扰动生成,每一步的对抗样本都投影到x+S , S∈Rd,Rd为d维的实数空间。1.2 基于RetinaNet算法的人头检测模型

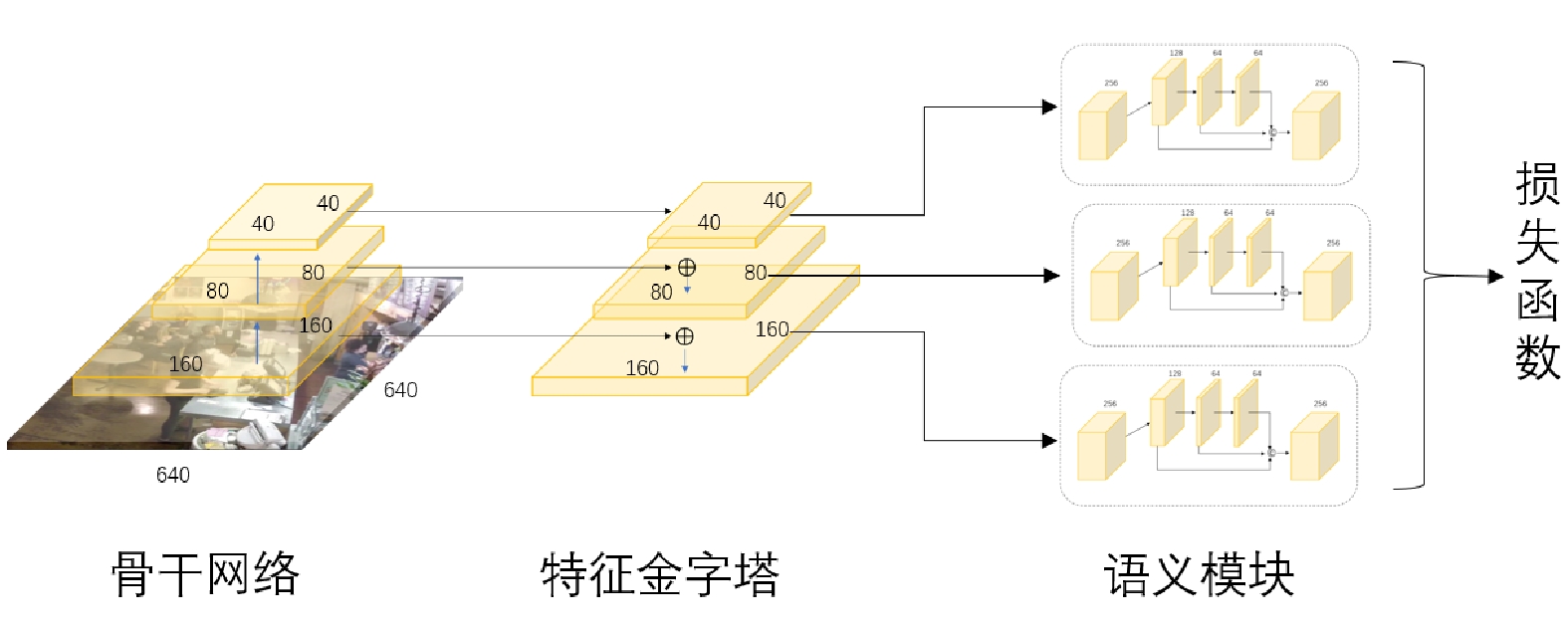

常用目标检测算法包括精度较高但推理速度较慢的双阶段目标检测算法和推理速度较快但精度稍差的单阶段目标检测算法。单阶段目标检测算法在推理速度方面具有优势,更适合对响应速度有较高要求的铁路客运场景。因此,本文基于单阶段目标检测算法RetinaNet构建了一种人头检测模型,用于铁路客运车站内的人群计数,模型网络结构如图1所示。

为降低模型参数量和提高推理速度,本文人头检测模型的骨干网络使用了基于深度可分离卷积的MobileNet[13]网络结构。骨干网络中特征图的边长经过步长为2的3×3卷积后会下降1倍,通常将边长相同的一组特征图,称为同一层级的特征图。RetinaNet检测算法输入的图像边长大小为640×640,骨干网络中共有5组步长为2的3×3卷积,所以有5个不同层级的特征图,边长分别为320×320、160×160、80×80、40×40和20×20。

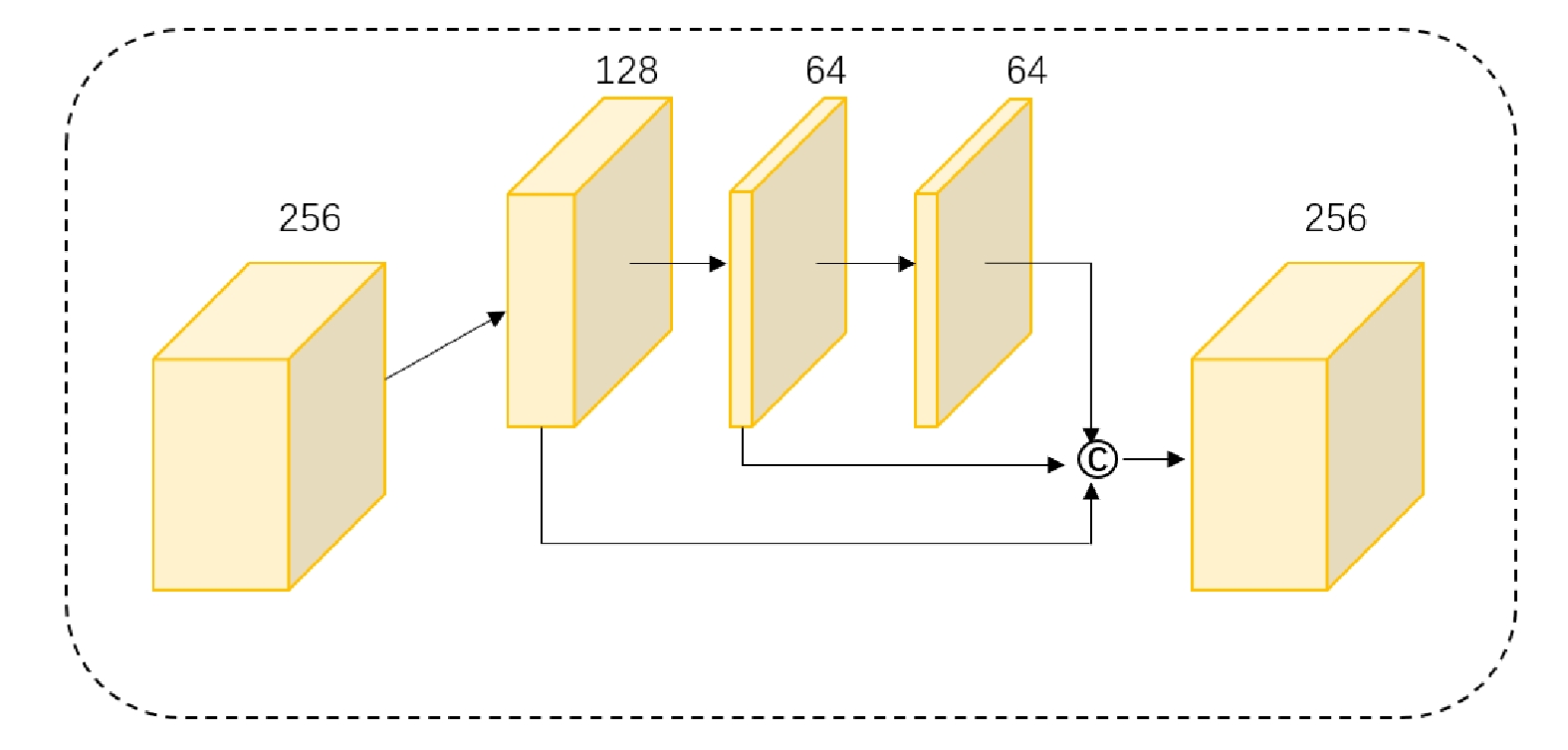

由于监控图像中人头占比较小,本文基于RetinaNet算法,使用骨干网络中第2、3、4层级的多层级特征图,构成自顶向下的特征金字塔网络[14](FPN,Feature Pyramid Networks),并在不同层级的特征图上设计了形状、大小均不同且数量众多的锚点框。FPN对多层级特征图信息的利用和对锚点框的设计,可增加模型对不同大小的人头的捕捉能力,获得出色的检测性能。FPN的每1层使用独立的语义模块,语义模块结构如图2所示,使用数量不同的3×3卷积对输入的特征图进行卷积操作,提高感受野,增强刚性语境的建模能力。对通道数量为256的特征图连续使用3×3的卷积进行卷积操作,并将得到的通道数为128、64、64的特征图进行拼接融合。

2 实验与结果分析

2.1 参数设定与实验数据

本文所有实验均在ubuntu 18.04操作系统环境下进行,使用Pytorch深度学习框架,基于Python 3.6进行编程。硬件部分:CPU为Inter Xeon Gold 5218 @ 2.3 GHz×2;GPU为NVIDIA Tesla V100 @ 32 GB;RAM为250 GB。

训练过程采用带有动量的随机梯度下降(SGD,Stochastic gradient descent)优化算法,动量大小为0.9,权重衰减系数为0.0006,批次大小为256。初始学习率设置为

10−5 ,使用warm-up方式使学习率在10轮迭代后上升到10−1 ,再使用Cosine Annealing学习率下降方式继续迭代,直至300轮迭代后停止训练。本文实验采用Brainwash密集人头检测数据集对模型进行实验训练、验证和测试[15]。Brainwash数据集通过监控设备采集室内人群图像,并标注人头位置。该数据集共分为训练集、验证集、测试集3部分,训练集用于算法的训练,验证集作为算法调优的标准,测试集用于测试算法的能力指标。其中训练集有10769张图像,包含81975个人头;验证集有500张图像,包含3318个人头;测试集有500张图像,包含5007个人头。

2.2 评价指标

为验证本文提出的人头检测模型的有效性,采用平均准确率(mAP,mean Average Precision)作为模型检测的精度评价指标。模型精确率P和召回率R的公式为

P=TPTP+FP (3) R=TPTP+FN (4) AP是某一类 P(R) 曲线下的面积,mAP 则是所有类别 P (R) 曲线下面积的平均值,因为本文只有一个类别,因此AP即为mAP,公式为

AP=∫10P(R)dR (5) 2.3 模型训练

本文采用Mosaic数据增强[16]方法对训练样本进行了数据增强,在训练过程中每次随机选取4张原始图像,对每张原始图像进行缩放、裁减等操作后,拼接为一张训练图像,如图3所示。该方法通过随机缩放等操作丰富了人头尺度和背景的多样性。由于该训练方式将4张图像进行了拼接,相当于同时用4倍批次的图像进行训练,降低了训练过程对硬件的要求。

使用原始训练集D1对人头检测模型进行训练,将训练得到的模型记为M1,M1模型在测试集上的mAP达到了93.26%,人头检测效果如图4所示。车站监控类型的图像检测效果如图5所示。

2.4 对抗样本生成和对抗攻击

对人头检测模型进行攻击主要有2种攻击途径:令模型将背景识别成人头和令模型将人头识别成背景。为便于描述,本文将第1种途径记为正向攻击;第2种记为逆向攻击。要对人头检测模型进行对抗攻击,降低模型精度,需要先生成对抗样本。

2.4.1 FGSM对抗算法

设定FGSM对抗算法的参数 ε=0.04,基于验证集生成对抗训练数据样本,使用FGSM对抗算法正向攻击生成的数据集记为D2+,逆向攻击生成的数据集记为D2−,并使用M1模型进行检测。FGSM对抗算法正/逆向攻击效果如图6所示。

2.4.2 PGD对抗算法

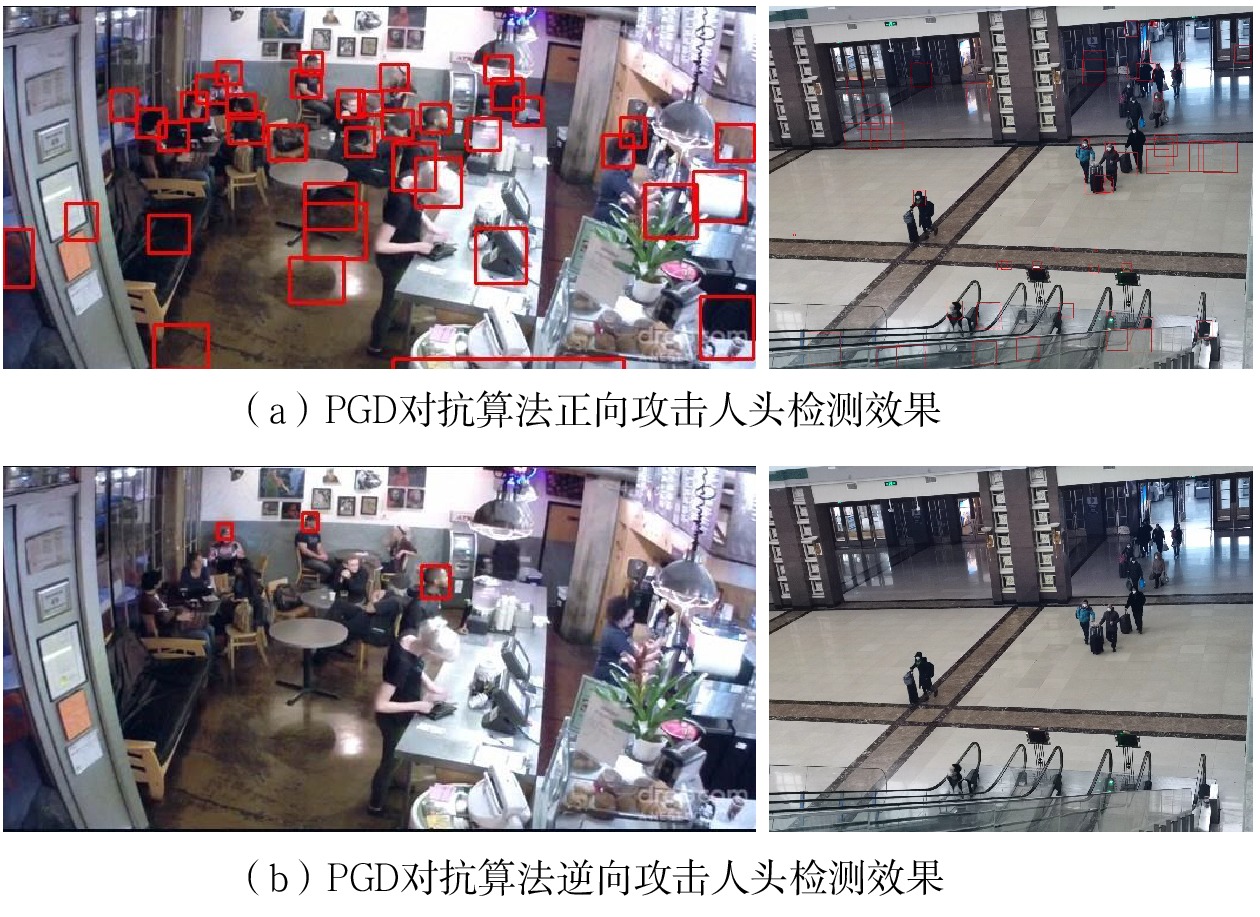

设定PGD的参数

α =0.03,迭代次数为10,基于验证集生成对抗训练样本,使用PGD对抗算法正向攻击生成的数据集为D3+,逆向攻击生成的数据集为D3−,使用M1模型进行检测。FGSM对抗算法正/逆向攻击检测效果如图7所示。2.4.3 对抗攻击结果分析

模型M1在不同方法生成的对抗样本数据集上获得的mAP值如表1所示。由表1可知,模型M1在FGSM或PGD对抗算法生成的对抗样本数据集上,人头检测精度均有明显下降,可认为完成了攻击。

表 1 初始模型M1在各类对抗样本数据集上的mAP值方法 正向攻击 逆向攻击 FGSM 63.66 65.37 PGD 58.53 65.39 2.5 检测模型对抗训练

将基于训练数据集的原始数据集D1和D2+融合得到新的数据集,训练得到的模型记为M2+;同理,将原始数据集D1与其余数据集融合后,训练得到的模型分别记为M2−、M3−和M3+。将原始数据集D1与D2+、D3+融合后训练的模型记为M4+,将原始数据集D1与D2−、D3−融合后训练的模型记为M4−。使用与训练M1模型时相同的参数和数据增强方法,对上述模型进行训练。各模型在基于不同对抗攻击方法产生的验证数据集上取得的结果如表2所示。

表 2 对抗训练结果模型 验证数据集 D1 D2+ D2− D3+ D3− M2+ 94.88 93.98 88.61 94.56 93.35 M2- 94.62 93.09 92.36 94.28 94.04 M3+ 94.56 93.27 87.16 94.36 93.14 M3- 94.49 91.03 89.15 93.77 93.73 M4+ 94.45 90.12 85.18 94.61 93.11 M4- 94.66 92.78 92.66 94.30 94.13 2.6 实验结果分析

(1)在FGSM和PGD对抗攻击方法生成的对抗样本上测试初始模型M1时,模型的检测性能由93.26%大幅下降至63.66%和58.53%,证明对抗攻击对模型性能的影响较为明显。

(2)基于某种对抗攻击方法和特定参数生成的数据集训练出的模型,在相同对抗攻击方法和参数生成的验证数据集上的性能有较大提升。例如,使用FGSM对抗攻击方法正向生成的对抗样本进行对抗训练,得到模型M2+,该模型在D2+数据集上的检测性能达到了93.98%,较63.66%有较大提升,其他方法结论类似。证明对抗训练能提高模型对特定攻击方法的对抗鲁棒性。

(3)使用两种对抗攻击方法和参数生成的逆向对抗样本进行对抗训练得到的模型M4-,在D2+和D3+验证数据集上性能也有一定的提升,证明了对抗训练能够提高模型的泛化对抗鲁棒性。

(4)对抗攻击生成的样本进一步丰富了数据空间的特征表达,使用多种对抗训练方式得到的模型,不但对多个对抗攻击方法均有较好的防御效果,还能将人头检测模型在原始测试集上的性能由93.26%提升至94.4%以上。

3 结束语

本文基于RetinaNet算法设计了一种适用于铁路客运车站的人头检测模型,并在Brainwash数据集上进行了实验验证。利用FGSM和PGD 2种对抗攻击算生成对抗样本,对模型进行对抗训练。证明了对抗训练不但能有效提高模型的对抗鲁棒性,还能提高模型的最终性能。下一步,将对双阶段目标检测算法进行对抗训练的验证,进一步提高人头检测模型的鲁棒性,提高铁路客运场景下的人头检测精度。

-

表 1 初始模型M1在各类对抗样本数据集上的mAP值

方法 正向攻击 逆向攻击 FGSM 63.66 65.37 PGD 58.53 65.39 表 2 对抗训练结果

模型 验证数据集 D1 D2+ D2− D3+ D3− M2+ 94.88 93.98 88.61 94.56 93.35 M2- 94.62 93.09 92.36 94.28 94.04 M3+ 94.56 93.27 87.16 94.36 93.14 M3- 94.49 91.03 89.15 93.77 93.73 M4+ 94.45 90.12 85.18 94.61 93.11 M4- 94.66 92.78 92.66 94.30 94.13 -

[1] 李 瑞,李 平,王万齐,等. 铁路车站旅客密度自适应场景估计与应用研究 [J]. 铁道运输与经济,2021,43(11):19-26. DOI: 10.16668/j.cnki.issn.1003-1421.2021.11.04 [2] 张亚伟,吕晓军,李 明,等. 智能视频监控系统在铁路旅客服务系统的研究与应用 [J]. 中国铁路,2020(1):109-113. DOI: 10.19549/j.issn.1001-683x.2020.01.109 [3] 方 凯,刘玉鑫,杨恩泽,等. 基于人群运动变化规律的异常行为检测算法 [J]. 铁路计算机应用,2021,30(7):39-43. DOI: 10.3969/j.issn.1005-8451.2021.07.007 [4] 张 馨,董承梁,汪晓臣,等. 基于改进YOLOv5s的列车车厢客流密度检测方法研究 [J]. 铁路计算机应用,2022,31(10):10-15. [5] 张秋亮,杨 栋,王建超. 铁路客运站客流监测系统设计及关键技术研究 [J]. 铁道运输与经济,2022,44(7):56-63. DOI: 10.16668/j.cnki.issn.1003-1421.2022.07.09 [6] 张 泓,范自柱,石林瑞,等. 一种基于多尺度特征融合的人头计数检测方法研究 [J]. 华东交通大学学报,2021,38(2):115-121. DOI: 10.16749/j.cnki.jecjtu.20210416.007 [7] Szegedy C, Zaremba W, Sutskever I, et al. Intriguing properties of neural networks[C]//2nd International Conference on Learning Representations, 14-16 April, 2014, Banff, AB, Canada. 2014.

[8] 纪守领,杜天宇,李进锋,等. 机器学习模型安全与隐私研究综述 [J]. 软件学报,2021,32(1):41-67. DOI: 10.13328/j.cnki.jos.006131 [9] Lin T Y, Goyal P, Girshick R, et al. Focal loss for dense object detection[C]//Proceedings of the IEEE International Conference on Computer Vision, 22-29 October, 2017, Venice, Italy. New York, USA: IEEE, 2017. 2999-3007.

[10] Goodfellow I J, Shlens J, Szegedy C. Explaining and harnessing adversarial examples[C]//3rd International Conference on Learning Representations, 7-9 May, 2015, San Diego, CA, USA. 2015.

[11] Kurakin A, Goodfellow I J, Bengio S. Adversarial examples in the physical world[M]. Yampolskiy R V. Artificial Intelligence Safety and Security. Boca Raton: CRC Press, 2018: 99-112.

[12] Madry A, Makelov A, Schmidt L, et al. Towards deep learning models resistant to adversarial attacks[C]//6th International Conference on Learning Representations, 30 April-3 May, 2018, Vancouver, BC, Canada. OpenReview. net, 2018.

[13] Howard A G, Zhu M, Chen B, et al. MobileNets: efficient convolutional neural networks for mobile vision applications [J]. IEEE Access, 2017(6): 1-14.

[14] Lin T Y, Dollár P, Girshick R, et al. Feature pyramid networks for object detection[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 21-26 July, 2017, Honolulu, HI, USA. New York, USA: IEEE, 2017: 36-944.

[15] Li W, Li H L, Wu Q B, et al. HeadNet: an end-to-end adaptive relational network for head detection [J]. IEEE Transactions on Circuits and Systems for Video Technology, 2020, 30(2): 482-494. DOI: 10.1109/TCSVT.2019.2890840

[16] Bochkovskiy A, Wang C Y, Liao H Y M. YOLOv4: optimal speed and accuracy of object detection [J]. arXiv preprint arXiv:, 2004, 10934: 2020.

下载:

下载: