Image processing optimization technology of railway passenger station video fusion intelligent monitoring system based on deep learning

-

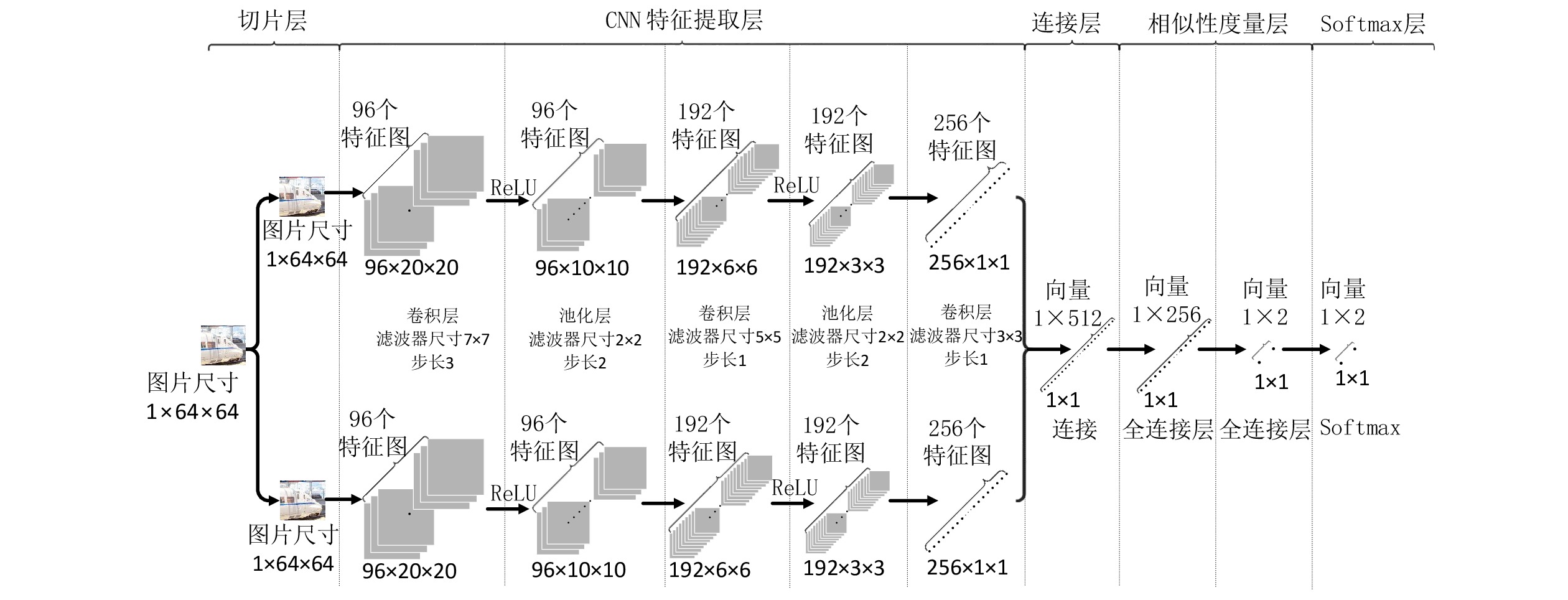

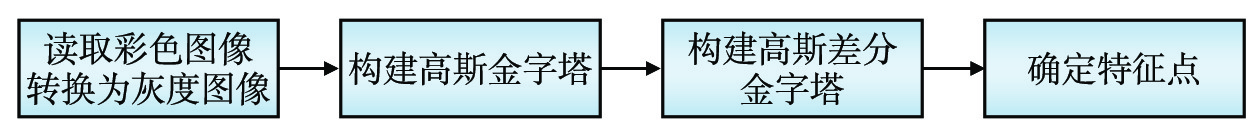

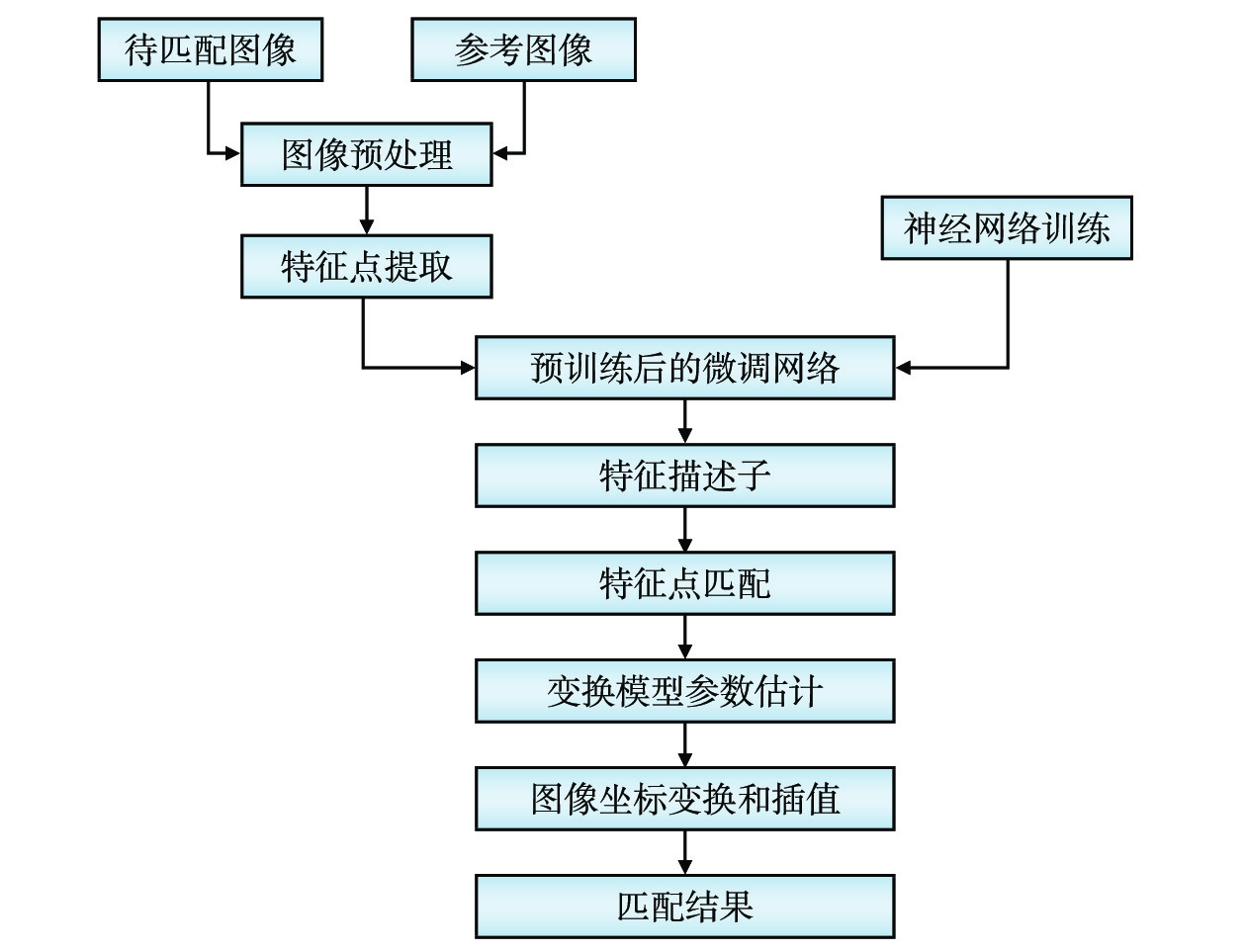

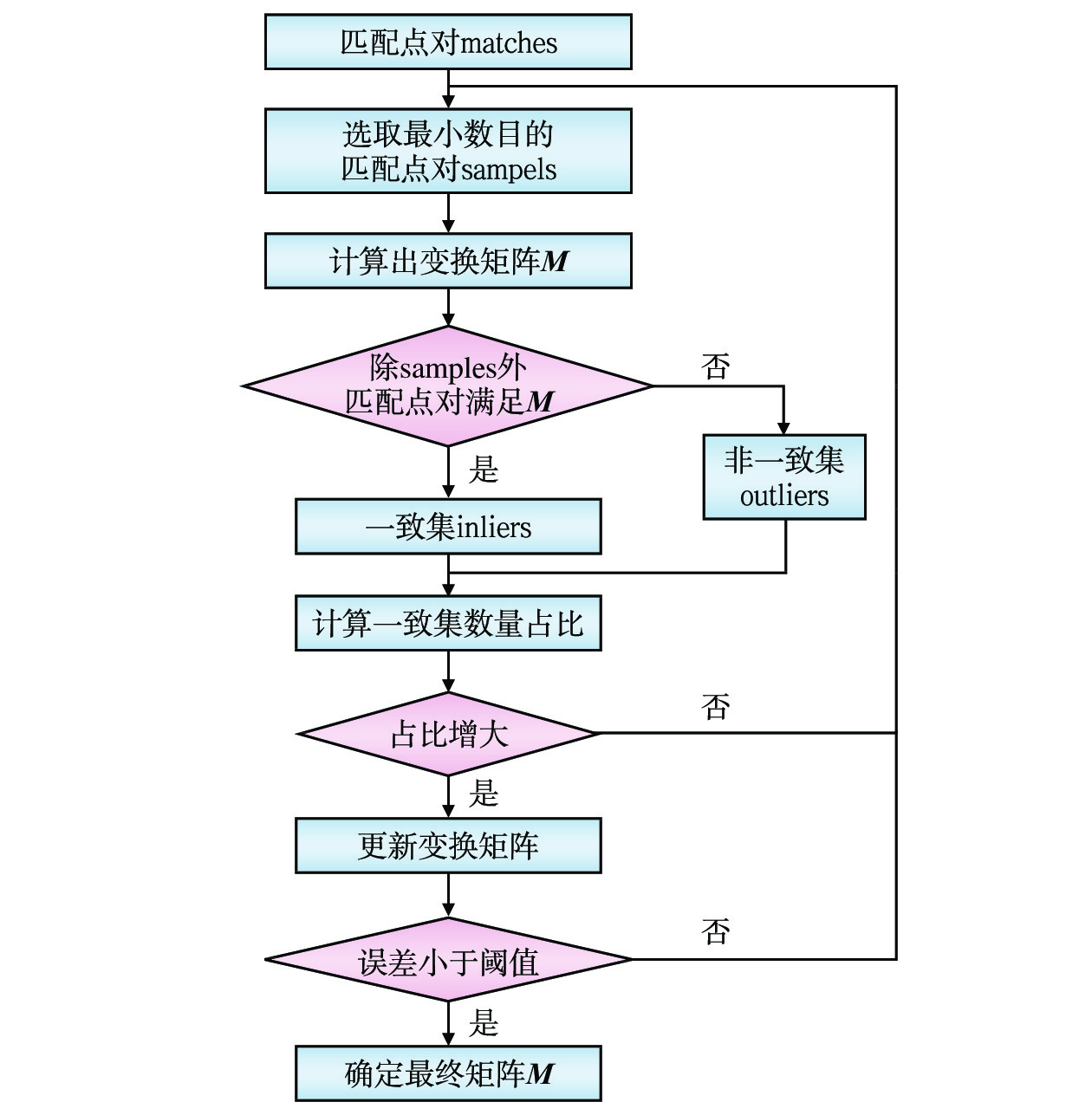

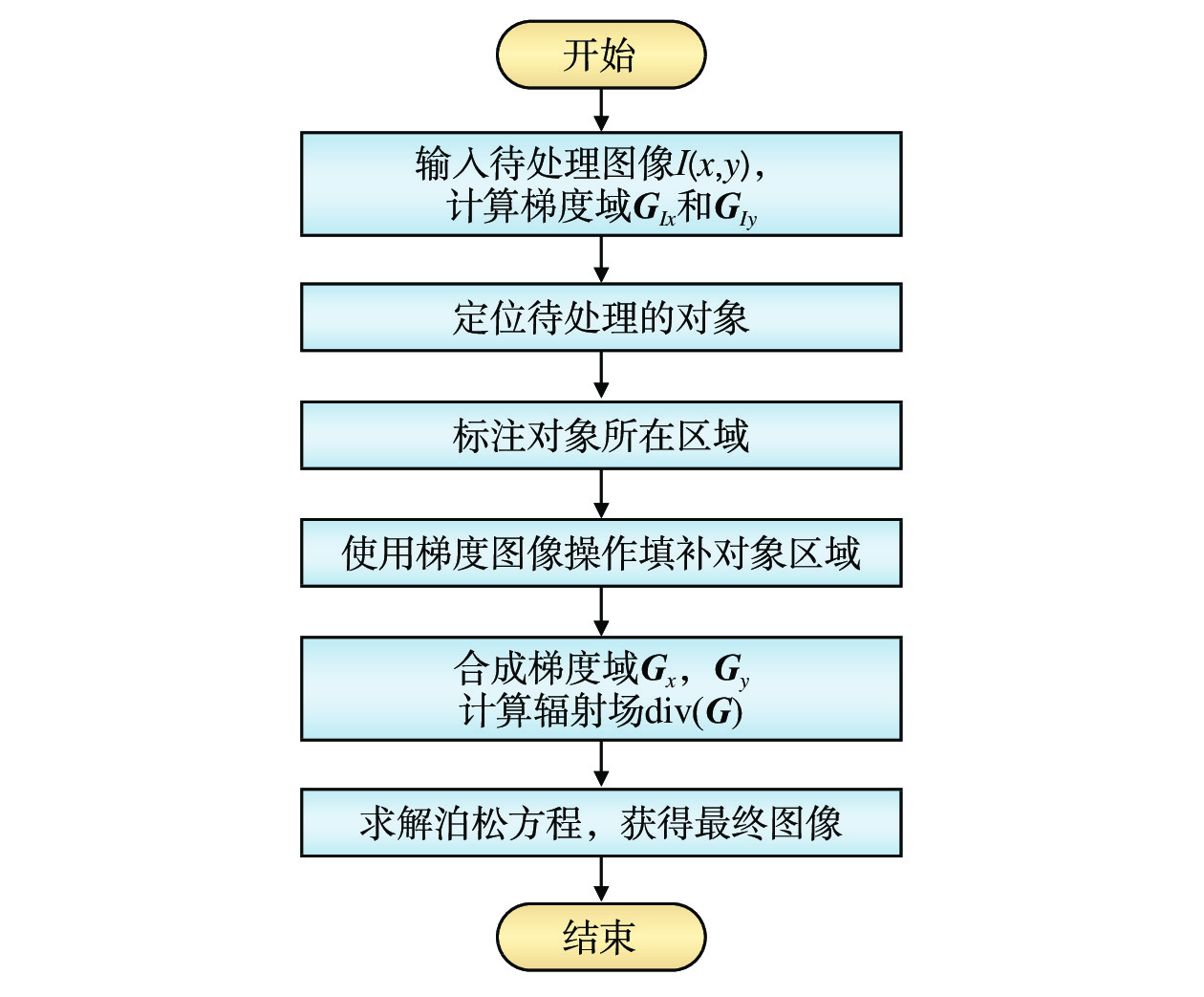

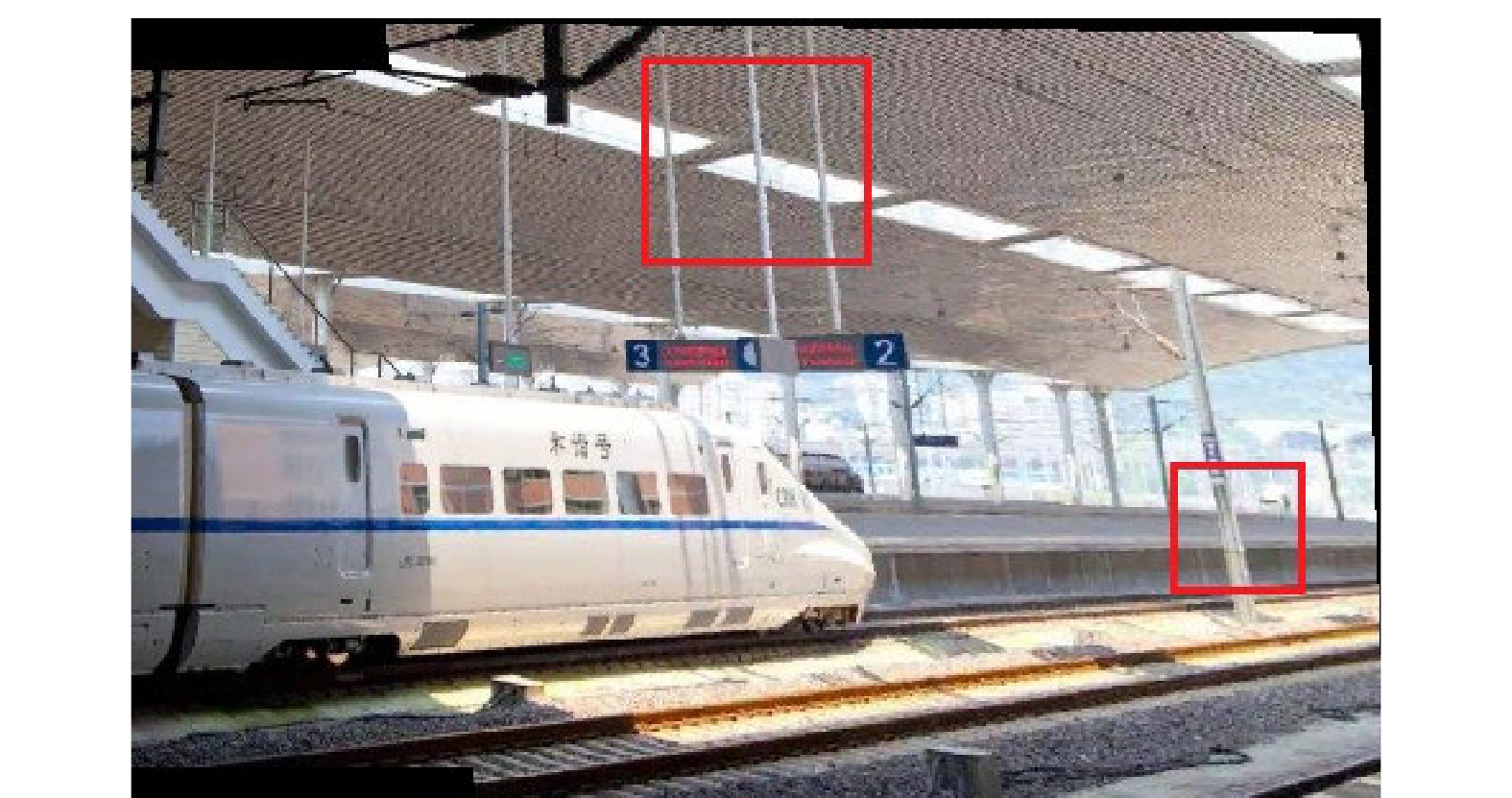

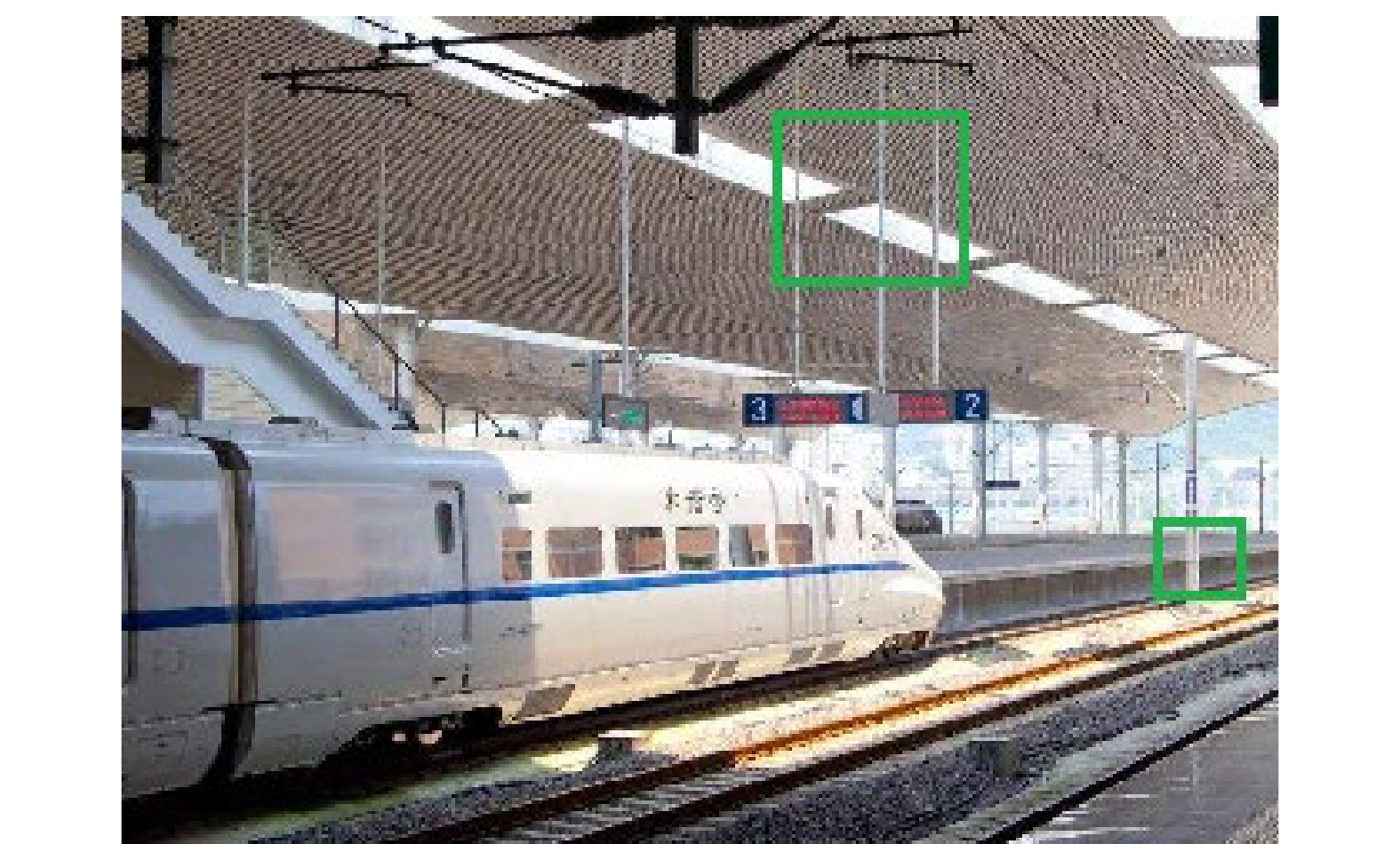

摘要: 针对复杂铁路客站现场全景视频高维特征缺乏、融合匹配不准确等问题,提出一种基于深度学习的铁路客站视频融合智能监控系统的图像处理优化技术。文章通过尺度不变特征变换算法检测出图像关键点,利用卷积神经网络进行高维特征提取,对错配点使用随机抽样一致性算法进行剔除,并对虚影问题进行了优化以获得更好的细节效果。提出的图像处理优化技术已应用于连云港—镇江高速铁路扬州东站。应用结果表明,该技术能有效防止图片失真,获得更好的拼接效果。Abstract: In view of the lack of high-dimensional features and inaccurate fusion and matching of panoramic video of complex railway passenger station, this paper proposed an image processing optimization technology of railway passenger station video fusion intelligent monitoring system based on deep learning. In this paper, scale invariant feature transformation algorithm was used to detect the key points of the image, convolution neural network was used to extract the high-dimensional features, random sampling consistency algorithm was used to eliminate the mismatch points, and the phantom problem was optimized to obtain better details effect. The proposed image processing optimization technology has been applied to Yangzhou East Station of Lianyungang-Zhenjiang high-speed railway. The application results show that this technology can effectively prevent image distortion and obtain better mosaic effect.

-

Keywords:

- deep learning /

- railway passenger station /

- video fusion /

- feature matching /

- image processing

-

铁路e卡通(简称:e卡通)是城际铁路公交化票制的重要载体,经过近5年高速发展,客户量已达到630万人,覆盖全国80条城际铁路线路和北京轨道交通全路网,满足了高铁通勤旅客无须购票、直接扫码或刷证乘车的现实需求,已成为中国国家铁路集团有限公司(简称:国铁集团)客运增量和经营增收的有力抓手[1]。

旅客使用e卡通进出站检票乘车时,可自行选择预约号或直接扫码乘车,检票系统根据各铁路局集团公司设置的乘车规则进行预授权冻结额度和席位分配。

(1)直接扫码乘车。检票闸机按照旅客设置的乘车区间分配席位,并以所乘车次的区间票价为限,自e卡通账户中预授权冻结额度;如旅客未设置乘车区间或设置的乘车区间与所乘车次不匹配,检票闸机按旅客所乘车次上车站至终到站分配席位,并以上车站至终到站的票价为限,自e卡通账户中预授权冻结额度。

(2)预约就座。旅客可使用e卡通预约当日2趟不同发到站的车次。铁路12306互联网售票系统(简称:12306),按照旅客预约的乘车区间随机分配列车席位,并以预约车次乘车区间的票价为限,自e卡通账户中预授权冻结额度。

旅客检票出站后,检票闸机从e卡通账户预授权冻结额度中扣取旅客实际乘坐区间的票款,并生成检票存根和乘车记录。e卡通扫码乘车的交易模式存在产生异常行程的可能,因乘车记录不完整,旅客下次将无法正常扫码乘车,同时运输收入管理部门也不能及时确认运输收入[2]。

针对异常行程的产生场景进行分析:旅客在进站或者出站时未使用乘车码、铁路检票闸机网络异常、相关系统或设备故障等会产生异常行程,导致检票后台无法匹配生成一笔正常的乘车记录(只有进站或只有出站记录);旅客预约订单取号后因个人原因或列车晚点等突发情况超过取消预约时间,导致旅客已预约席位但未乘车使用,e卡通账户内形成一笔预授权冻结的预约订单。如何针对异常行程和已预约未乘车状态的订单进行及时处理,以及如何减少异常行程的生成,提高用户行程匹配的准确率,成为e卡通资金风险管控中亟待解决的问题[2]。为此,本文研究面向旅客、车站工作人员和e卡通运营维护(简称:运维)人员的异常行程处理机制。

1 异常行程处理机制

按照国铁集团收入管理要求,兼顾资金风险和旅客便利乘车的原则,检票系统每日定时轮询e卡通旅客乘车记录,筛选异常行程检票存根和已预约未乘车状态的订单,检票系统在T+1日(第2个工作日)内通过铁路12306App消息系统和中铁银通短信平台向旅客下发e卡通乘车记录不完整信息,督促旅客利用多种方式在规定时间内处理异常行程,使e卡通账户恢复至正常状态。

1.1 铁路12306App异常行程自助补登机制

e卡通旅客收到异常行程处理的消息提示后,登录本人铁路12306App,根据弹窗提示自助补全进站或出站信息,形成一条进/出站完整的乘车记录。

铁路12306App调用与检票系统相关的接口,联机处理旅客异常行程补登流程,只需要旅客核实日期、上车站、所乘坐车次、票价(默认所乘车次上车站至终到站的票价作为补登行程时的票价依据),点击确认扣款,扣款成功后,即可生成正常检票存根,乘车记录将直接显示扣款金额和优惠金额[3],铁路12306App异常行程自助补登机制如图1所示。

1.2 进/出站异常行程人工处理机制

新增e卡通进/出站异常行程人工处理流程。车站工作人员对旅客e卡通异常行程进行处理时,可根据实际情况选择补全或注销异常行程。为提高业务处理安全性,车站工作人员注销异常行程时需要增加复核权限。

铁路车站e卡通窗口工作人员可通过以下方式查询旅客名下e卡通账号和乘车信息:身份证读卡器识读旅客二代身份证、二维码扫描枪识读e卡通乘车码或人工输入旅客身份证号码、姓名。通过查询e卡通账户信息,可展示旅客进站、车次信息和预约订单,结合旅客提供的相关证据,车站工作人员按照各铁路局集团公司e卡通业务管理办法的规定进行注销或补录异常行程、取号约号等操作。异常行程人工处理机制如图2所示。

1.3 超期限异常行程批量处理机制

旅客未在规定时间内通过铁路12306App自助异常补登或e卡通业务窗口人工处理,需要在检票系统后台建立e卡通异常行程批量处理机制。该机制可按照各铁路局集团公司收入管理部门、e卡通用户服务协议和管理办法的规定,自动对超过设定期限的所有e卡通旅客的异常行程强制批量处理。强制处理规则统一按照旅客设置的乘车区间、所乘车次上车站至该车次终点站或预约订单区间的票价,自e卡通账户的预授权冻结额度内扣款,并生成正常的检票存根和乘车记录,完成票款入账[4]。如对异常行程处理有异议,可联系客服。超期限异常行程批量处理机制如图3所示。

2 e卡通异常行程处理功能设计

本文在异常行程产生场景和流程设计的基础上,基于现有铁路客票系统研究并开发了面向旅客、车站工作人员和e卡通运维人员的3个异常行程处理机制,可实现数据自动统计和日志备份功能,使得铁路12306App、检票系统、电子支付系统和银行系统间信息自动传输与更新[5]。

2.1 铁路12306App异常行程自助补登功能

铁路12306App 异常行程自助补登功能主要包括异常行程判定、补登功能智能显示、弹窗提示、异常行程置顶、多车次筛选、自助补登和人工申诉等。

(1)异常行程判定。铁路12306App后台判断当前时间大于指定车次列车终到站时间+预留晚点时间n(n为定义参数)时,符合异常乘车记录定义,则判定为存在异常行程。

(2)补登功能智能显示。铁路12306App后台设置异常行程自助补登智能显示控制参数,配置仅限异常行程旅客的指定参数,使其进入自助补登页面。

(3)弹窗提示。异常行程旅客点击12306App的“扫码进出站”功能按钮时,如有异常记录,铁路12306App则弹出提示“您有一条异常乘车记录,请立即处理”,同时乘车码进入置灰状态,直至乘车记录正常时,方可正常展示e卡通乘车码。

(4)异常行程置顶。e卡通乘车记录内置顶显示异常行程,若旅客完成异常行程处理,铁路12306App实时将异常行程恢复为正常乘车行程。

(5)多车次筛选。铁路12306App展示异常行程的乘车日期、车次、进站信息,这3项数据均不得为空。

(6)自助补登。异常行程旅客核实所乘车次、上车站、乘车日期和票价无误后,可一键确认扣款,完成异常行程自助补登。

(7)人工申诉。对于异常行程自助补登失败的情况(不限于铁路调图导致的车次取消或调整为非e卡通应用车次)或12306判断e卡通账户内的预授权额度不足以支付当前票款,均不允许自助补登,旅客可通过人工申诉,按铁路12306客服人员指示,携带相关证件前往办理e卡通业务的铁路窗口进行人工处理。

2.2 进/出站异常行程人工处理功能

进/出站异常行程人工处理主要包括窗口权限定义、操作员设置、异常行程检测、预约订单处理、注销记录和扣款确认等。

(1)窗口权限定义。铁路车站售票窗口、到站补票窗口安装进、出站异常处理系统,须进行窗口权限定义,同时配置e卡通终端号。

(2)操作员设置。复用铁路售票窗口操作员的工号、密码和班次,无须再次申请工号。

(3)异常行程检测。通过识读二代身份证、乘车码或人工输入旅客身份证号码的形式获取旅客e卡通账户信息,并检测e卡通账户内是否存在异常行程。

(4)预约订单处理。可以查询旅客预约订单信息、状态,具备取消预约订单功能。

(5)注销记录。如遇旅客已人工补票或其他原因导致无法正常乘车的情形,通过人工补票的票号、检票数据或选择实际未实际乘车原因,可正常进行注销异常行程操作[6]。

(6)扣款确认。铁路车站售票窗口工作人员按照进/出站异常处理系统查询出的旅客异常行程,下拉选择所乘车次和终到站,直接完成扣款;也可以人工输入发到站、车次和乘车日期完成扣款。

2.3 超期限异常行程批量处理功能

自e卡通账户预授权冻结额度内批量扣款,完成乘车记录修正,主要包括平台管理、短信发送、统计分析、终端加密和异常行程匹配等功能。

(1)平台管理。建立e卡通异常行程批量匹配程序工具平台,可选择扫码乘车异常行程的时间,各铁路局集团公司检票服务器查看检票存根上传情况,并对检票存根无法上传的情况进行预警。

(2)短息发送。包括短信内容导入、自定义模板设计和批量发送短信等。对于符合异常行程判定规则的旅客,按照短信模板内容,由运营人员确认后一键发送。

(3)统计分析。该功能包括短信发送、异常行程和交易金额等情况的统计分析,按日、月、年生成报表,便于e卡通业务运维人员查看、分析异常行程处理情况。

(4)终端加密。设置e卡通独立银行密钥,在异常行程批量匹配过程中进行单独的终端号设定,保障旅客资金交易的完整性和准确性,并可以识别该e卡通交易为强制异常行程处理。

(5)异常行程匹配。按照旅客扫码乘车的业务场景,设置异常行程匹配规则,可按照各铁路局集团公司e卡通业务管理办法自动实现车次匹配从e卡通账户内冻结的预授权金额里扣取票款。

3 关键技术

e卡通异常行程处理机制和相关应用中主要涉及检票记录一致性校验、账户资金预授权冻结额度内扣款、注销等多个层面,本文介绍检票记录一致性核验和资金安全性保障方面的关键技术。

3.1 行程数据核验技术

针对e卡通异常行程处理进行业务流程再造,在异常行程自助补登过程中,采用数据挖掘技术和算法对比,将处理的旅客异常行程与近半年内的常用出行数据进行对比,核验旅客异常行程补登的乘车区间、频次是否一致,以便快速完成异常行程自助补登,同时为车站工作人员和e卡通运维人员提供补全异常行程的依据。

3.2 数据加密技术

为保障资金交易的准确性和完整性,设计了基于e卡通账户、异常处置数据、合作银行交易安全特性的数字化数据加密算法。在整个异常行程处理机制中,通过检票终端和后台系统,使用数字密钥及加密函数对旅客身份证号码、e卡通卡号和密码进行加密转换,合作银行执行扣款交易时,将收到的扣款请求经解密秘钥、解密函数进行交易数据还原,以保障交易的合法性和准确性。

3.3 数据库存储过程技术

超期限异常行程批量处理的实现基于数据库存储过程,该过程部署于国铁集团数据中心,此种方式可以使程序拥有更快的执行速度,只需要在部署时编译一次即可,以后每次执行存储过程都不需要重新编辑,能够提高数据库执行速度;数据库存储过程与事务更好地结合,保证e卡通检票、乘车记录和资金交易数据操作的一致性,当对数据库表进行复杂操作时,可将此复杂操作进行封装后,与数据库提供的事务处理一起使用,使得e卡通相关数据能够及时与铁路内部各运营系统进行数据交换;异常行程处理相关程序的代码安全性高,可以对程序进行赋权和隐藏源代码[7]。

4 e卡通异常行程处理机制应用场景

e卡通异常行程处理机制首先在中国铁路兰州局集团有限公司和中国铁路南昌局集团有限公司试点运行,随后在全国12个铁路局集团公司400多个e卡通应用车站推广实施。

e卡通运维人员通过检票后台如图4所示,监控e卡通检票存根,导出前一日异常行程数据,按照短信平台模板要求完成信息录入,向e卡通异常行程旅客推送消息。

5 结束语

本文以e卡通异常行程的处理机制作为研究对象,设计了面向旅客、车站人员和e卡通运维人员的3个应用机制,保障了铁路运输收入资金的安全、完整,进一步夯实了铁路运输收入内控制度[8]。目前,e卡通异常处理机制已在14个铁路局集团公司进行了大范围应用,检票数据处理准确、高效,各应用机制间信息传输快速、稳定,为e卡通在全国铁路的推广奠定了基础,未来,还须结合e卡通在城市轨道交通的延伸应用,构建互联互通的异常行程补登平台。

-

[1] 王 娟,师 军,吴宪祥. 图像拼接技术综述 [J]. 计算机应用研究,2008,25(7):1940-1947. DOI: 10.3969/j.issn.1001-3695.2008.07.005 [2] 王跃军,易 力. 基于三维场景的视频融合技术在电厂智能巡视系统中应用的研究 [J]. 中国设备工程,2021(3):123-125. [3] Rublee E, Rabaud V, Konolige K, et al. ORB: An efficient alternative to SIFT or SURF[C]//2011 International conference on computer vision. Barcelona, Spain : IEEE, 2011: 2564-2571.

[4] Liu Z, Li Z, Zhang J, et al. Euclidean and Hamming Embedding for Image Patch Description with Convolutional Networks[C]// IEEE Conference on Computer Vision and Pattern Recognition 2016 (CVPR 2016). Las Vegas, NV, USA: IEEE, 2016.

[5] Simo-Serra E, Trulls E, Ferraz L, et al. Discriminative learning of Deep Convolutional Feature Point Descriptors[C]// IEEE International Conference on Computer Vision. Nanchang, China: IEEE, 2016.

[6] 王红尧,吴佳奇,林 松,等. 矿井多视角图像拼接方法研究 [J]. 工矿自动化,2021,47(10):27-32. [7] Zagoruyko S, Komodakis N. Learning to Compare Image Patches via Convolutional Neural Networks[C]// 2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Boston, MA, USA: IEEE, 2015.

[8] Han X, Leung T, Jia Y, et al. MatchNet: Unifying feature and metric learning for patch-based matching[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Boston, MA, USA: IEEE, 2015.

[9] Balntas V, Johns E, Tang L, et al. PN-Net: Conjoined Triple Deep Network for Learning Local Image Descriptors [J]. arXivpreprint arxiv:1601.05030, 2016.

[10] Brown M, Hua G, Winder S. Discriminative learning of local image descriptors [J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2011, 33(1): 43-57. DOI: 10.1109/TPAMI.2010.54

[11] Kumar B G, Carneiro G, Reid I. Learning Local Image Descriptors with Deep Siamese and Triplet Convolutional Networks by Minimising Global Loss Functions[C]// IEEE Conference on Computer Vision and Pattern Recognition 2016 (CVPR 2016). Las Vegas, NV, USA: IEEE, 2016.

[12] 于俊清,吴泽斌,吴 飞,等. 多媒体工程:2016——图像检索研究进展与发展趋势 [J]. 中国图象图形学报,2017,22(11):1467-1485. DOI: 10.11834/jig.170503 [13] Zhang G, Zhi Z, Zhang S, et al. SIFT Matching with CNN Evidences for Particular Object Retrieval [J]. Neurocomputing, 2017, 238(238): 399-409.

[14] 魏利胜, 周圣文. 新型优化SIFT的图像快速配准方法研究[J]. 计算机工程与应用, 2015, 51(5): 167-171. [15] Dubey S R, Chakraborty S. Average biased ReLU based CNN descriptor for improved face retrieval [J]. Multimedia Tools and Applications, 2021, 80(15): 23181-23206. DOI: 10.1007/s11042-020-10269-x

[16] 赵迪迪,李加慧,谭奋利,等. 基于分布度量和显著性信息的遥感图像拼接 [J]. 激光与光电子学进展,2022,59(4):121-129. [17] 俞 娜. 多摄像头协同的运动目标跟踪方法研究[D]. 桂林: 桂林理工大学, 2021. [18] 刘 震. 一种基于深度学习的多曝光高动态范围成像方法 [J]. 现代计算机,2021(6):91-94. [19] 李佳骏. 基于局部特征的图像与点云配准研究[D]. 大连: 大连理工大学, 2021.

下载:

下载: